- ChatGPTが犯罪の補助ツールとして悪用され、サイバー犯罪が巧妙化

- 情報漏洩を防ぐため個人情報や機密情報の入力および公序良俗に反する利用は厳禁

- 手口の把握やChatGPT公式サイトの利用など、リスクを最小限に抑える工夫が必要

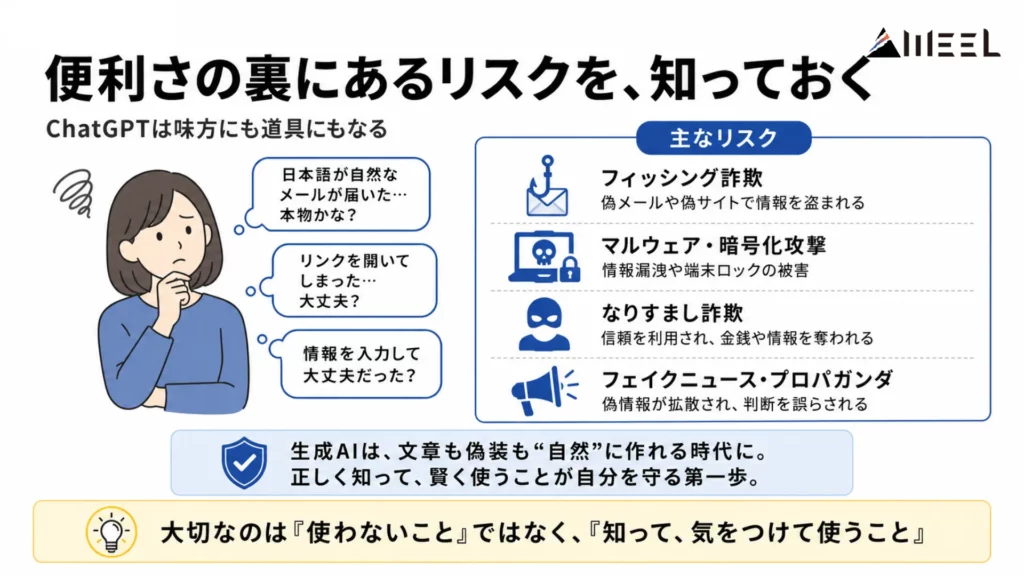

ChatGPTの普及とともに、犯罪に悪用されるリスクも増えています。日本語を話せないはずの人が日本人女性になりすまして、流暢な日本語のメッセージを送ったり、企業や団体を装って、偽サイトへのアクセスを誘導する文章を送ったりしています。

これらは全てChatGPTで瞬時に生成できるため、私たちの身近にもさまざまな危険が潜んでいます。この記事では、ChatGPTの悪用による想定される被害、実際の犯罪や不正利用の事例、被害に遭わないための対策を紹介します。

最後まで読むことで、ChatGPTを用いた犯罪の手口を知ることができ、自身への被害を防げるようになります。

\生成AIを活用して業務プロセスを自動化/

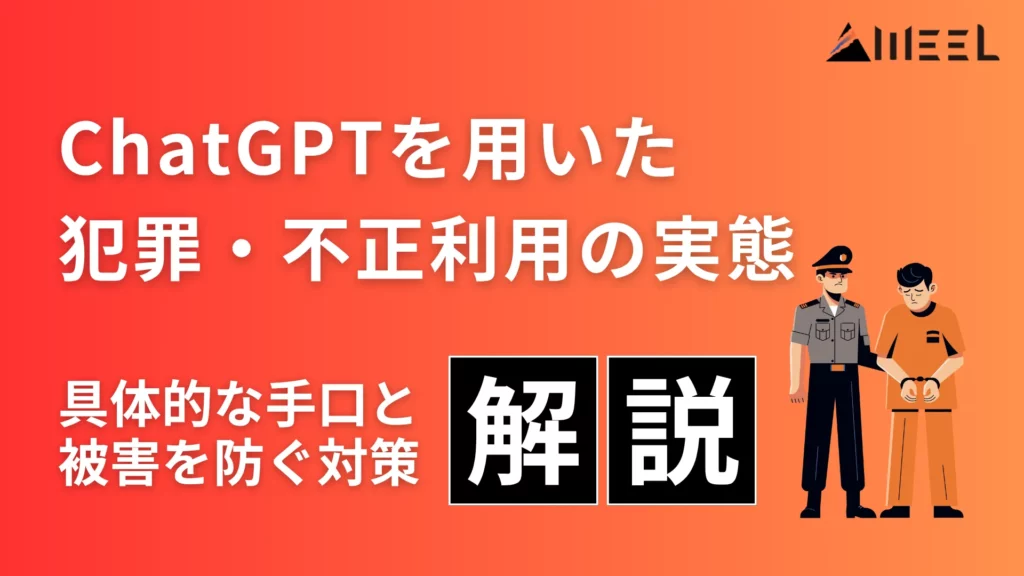

ChatGPTを用いた犯罪・不正利用は実際に発生している

本来、ChatGPTは文章作成や要約、情報整理、アイデア出しなどを支援する便利なツールです。しかし、実際には詐欺メッセージやフィッシングメールなどのサイバー犯罪の文面作成、不正行為の情報収集などに悪用された事例があります。これに対し、OpenAIは有害なリクエストには応答せず、アカウント警告が行われるとしました。※1

また、重大な危害の脅威がある場合、人間のレビューチームが確認したうえで警察などへ通報される可能性もあるとしています。

ただし、全ての犯罪や不正行為を防げるわけではありません。例えば「好きな人に連絡したいから文案を考えて」と指示して、生成された文章がなりすましに利用される可能性もあります。

ChatGPTを使った犯罪・不正利用で考えられる被害

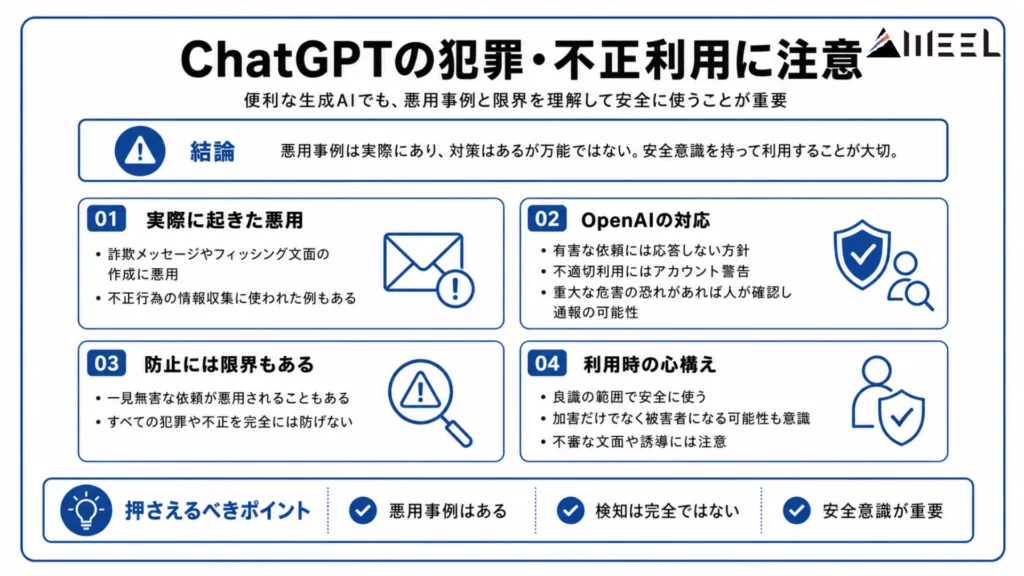

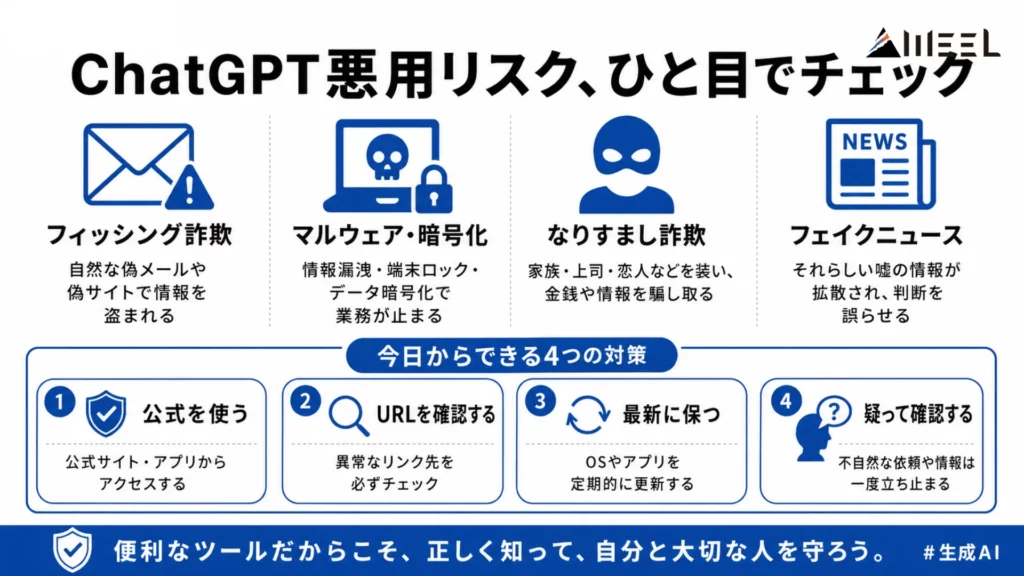

ChatGPT自体が犯罪を行うわけではありませんが、犯罪者が文章生成や偽装を効率化する道具として悪用すると、金銭詐取、認証情報の窃取、端末感染やデータ暗号化などの被害が生じます。ここでは、被害者側に起こりやすいリスクを整理します。

フィッシング攻撃

ChatGPTを悪用すると、銀行・ECサイト・宅配業者・社内連絡などを装う偽メールの文面を容易に量産可能です。相手に合わせて文面を調整できるため、個人名や利用サービスに寄せた巧妙な誘導が増加しています。

偽サイトへ誘導し、ID・パスワード・カード情報などを入力させて不正ログインや不正決済へつなげる手口が一般的です。企業においては、1人の認証情報流出が社内システム侵入や取引先被害に波及するかもしれません。

以前のように「日本語が変だから怪しい」とは限らないため、自然な文面でもURLや送信元の確認が不可欠でしょう。

マルウェアや暗号化ツールによる攻撃

ChatGPTの悪用で不正プログラム作成のハードルが下がり、専門知識が浅くても攻撃の補助情報を得やすくなりました。実害は以下のとおりです。

- 情報漏洩

- 端末ロック

- データ暗号化

- 業務停止

個人なら写真・連絡先・保存パスワードの流出、企業なら顧客情報漏洩・復旧費用・営業停止損失へと被害が拡大します。また、偽の関連ツールを装ってマルウェアが配布されるケースもあり、安易な導入は危険です。

被害は単にデータが盗まれるだけでなく、使えなくされる・復旧コストが発生する点まで押さえておく必要があります。

なりすまし詐欺

ChatGPTの悪用により、家族・上司・取引先・恋愛相手などを装った自然な文章が短時間で作りやすくなりました。従来の手がかりであった不自然な日本語の違和感が薄れ、非常にだまされやすい状況です。

具体的な被害としては、以下のとおりです。

- 送金要求

- 電子マネー購入

- 認証コードの聞き出し

- 個人情報流出

- アカウント乗っ取り

さらに、ChatGPTの画像生成により、偽の本人画像やプロフィールと組み合わせることで信用性が増します。

AIを使った犯罪について詳しく知りたい方は、下記の記事を合わせてご確認ください。

ChatGPTの悪用・犯罪ケース

ChatGPTの普及に伴い、さまざまな不正利用や犯罪の事例が報告されています。学生による課題の代行から銃撃事件まで、悪用リスクは広範囲です。ここでは、ChatGPTを悪用した不正行為や犯罪の具体例を解説します。各リスクの実態を把握し、安全な利用への理解を深めましょう。

試験・課題の代行

上記はChatGPTによって基本情報技術者試験の内容を回答させた例です。

ChatGPTによって、学校の課題やオンライン試験に悪用されることで、不正な資格取得や教育への悪影響が懸念されます。実際、スタンフォード大学の学生のうち、17%が「課題または試験にChatGPTを使用している」と回答しています。※2

また、ChatGPTによる学習への悪影響を懸念して、ニューヨーク市では学校でのChatGPTの利用を禁止しました。※3一方で、ペンシルベニア大学のモリック教授は、学習においてChatGPTの使用を学生に義務付けています。※4

フェイクニュースの作成

ChatGPTではそれらしい記事やニュースも作成可能です。例えば、日本が政策金利を引き上げたという内容の嘘のニュース文面を生成できます。実際のニュースと比べても見分けがつかないクオリティになっており、このニュースだけを見たら真実かと思ってしまいます。

また東洋経済によると、ChatGPTによるフェイクニュース拡散で中国の政府系放送局が対応に追われるなどの実害も報告されています。※5

なりすまし

ChatGPTでは、他人が書いたような自然な文章を簡単に生成可能です。特定の性別・年齢層・職業などの属性を指定して出力させることで、ターゲットの人物像に合わせた文面を生成できます。

こうした機能を悪用した場合、他人になりすまして相手の信頼を利用し、不正に個人情報・金銭を搾取する小中規模の犯罪が発生します。実際にOpenAIのレポートでも、ロマンス詐欺にChatGPTなどのAIが悪用された事例を報告しています。※6

詐欺グループは主に中国語を話すメンバーで構成されていましたが、生成AIを活用することで、若い女性を装い自然な英語や日本語でメッセージを送っていました。

フィッシング詐欺

フィッシング詐欺とは、実在する企業や団体などを装って偽のサイトへ誘導し、個人情報や金銭を騙し取る犯罪です。生成AIを利用して偽のメール・SMSの文面を作成し、偽サイトへ誘導する手法が考えられます。

実際に、ChatGPTの偽サイトやアプリが登場しており、以下の事例が確認されています。※7

- IDやパスワードなどのユーザー情報を不正に取得

- アドウェアやスパイウェアのインストールに誘導

- ユーザーの知らないうちに高額なSMSサービスに登録させ、料金を請求

これらはChatGPTを使った犯罪ではありませんが、上記のような事例にChatGPTが悪用される懸念があります。

マルウェア作成・ハッキングへの悪用

ChatGPTは悪意のあるプログラムコードの生成に利用可能であり、すでにサイバー犯罪者による悪用が始まっています。※8実際に、感染デバイスから情報を盗み出すマルウェアの作成過程がネット上に公開されました。

また、ペネトレーションテストを装った質問に対し、AIがハッキング活動に利用可能な手順を生成したケースも報告されています。※9

このように、一般的なファイル形式を悪用したプログラム作成など、国家・企業規模の脅威に発展するおそれがあります。

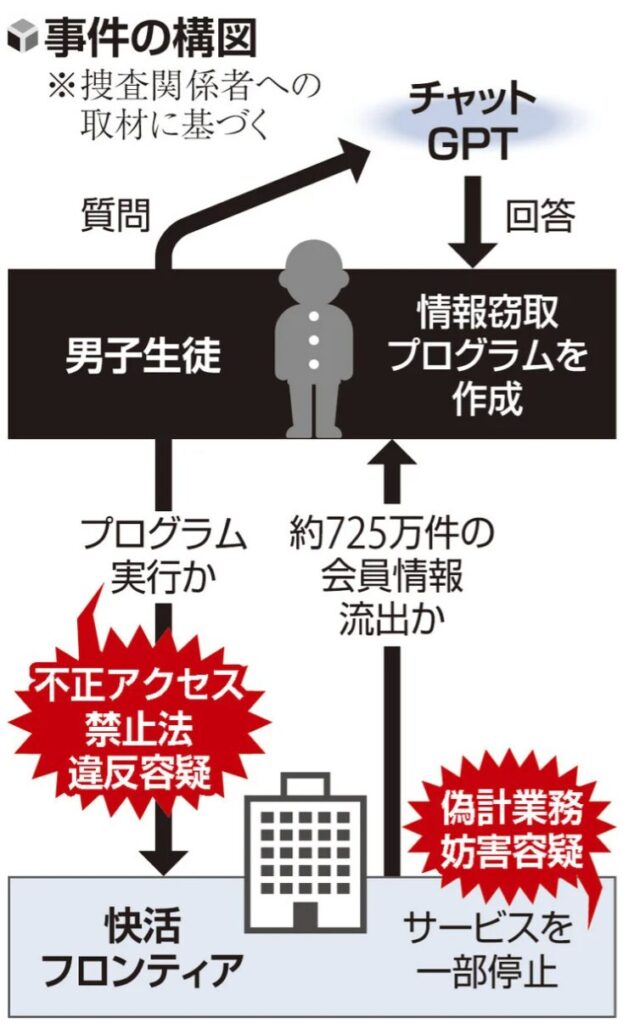

高校生によるサイバー攻撃

若年層が、生成AIを用いてサイバー犯罪に手を染める事例も発生しています。国内では、高校生がChatGPTを悪用して快活CLUB公式アプリのサーバーへサイバー攻撃を仕掛け、逮捕される事件が起きました。※10

この事件では、高校生が情報窃取のために自作したプログラムについて、攻撃対象のシステムの防御策をすり抜ける方法や、エラーが出た際の対応などをChatGPTに質問し、攻撃プログラムを改良していた手口が判明しました。

プロの犯罪者でなくても、生成AIの支援を受けることでサイバー攻撃が可能になってしまいます。

暴力・凶悪犯罪への利用

ChatGPTが殺人や銃乱射といった、直接的な暴力・凶悪犯罪の実行を補助するリスクも顕在化しています。実際にアメリカのフロリダ州で発生した銃乱射事件では、容疑者が犯行前にChatGPTとやり取りしていたことが判明しました。※11

フロリダ州の司法長官はAIによる犯行の助言・教唆があったとして、開発元のOpenAIの刑事責任を問う捜査を開始しています。同州の司法長官は「人間であれば殺人罪で起訴していただろう」と述べています。AIが人命に関わる重大な犯罪に利用される危険性は無視できないでしょう。

プロパガンダへの利用

ChatGPTで政治的な主張や陰謀論を生成し、プロパガンダに活用することも可能です。 過去には、ChatGPTが政治的な公平性を欠いているのではとの指摘もありました。

この指摘が正しいか定かではありませんが、ChatGPTが、ドナルド・トランプ氏のポジティブな面に関するポエムを書くことを拒否した後、ジョー・バイデン氏に関する同テーマのポエムを書いた事例もあります。※12

またOpenAIが、ChatGPTを悪用してアメリカ大統領選挙の偽情報を生成したイランのアカウントを特定し、停止させた事例もあります。情報を取得するときは、本当に正しいか確認しましょう。

ChatGPTに聞いてはいけないこと

ChatGPTは便利な一方で、何でも入力してよいわけではありません。入力内容によっては、情報漏洩やトラブルの原因になることもあります。特に注意したいのは、個人情報や企業の機密情報、そして公序良俗に反する内容です。

個人情報や企業の機密情報

ChatGPTに個人情報や企業の機密情報、顧客情報などを入力するのは避けましょう。入力した内容がAIに学習され、サービス改善や品質向上のために活用されたり、意図しない形で別の回答に再利用されたりする可能性はゼロとはいえません。チャット履歴を削除しても、サーバー上で一定期間保管・管理されます。以下の内容を入力しないよう、注意してください。

| 入力を避けたい情報 | 具体例 |

|---|---|

| 個人情報 | 氏名、住所、電話番号、メールアドレス、生年月日 |

| 金融・認証情報 | 口座情報、クレジットカード情報、パスワード、認証コード |

| 企業の機密情報 | 顧客情報、未公開企画、契約内容、社内資料、売上データ、ソースコード |

公序良俗に反する内容

公序良俗に反する内容もChatGPTに聞いてはいけません。

- 誹謗中傷や名誉を傷つける内容

- 差別・脅迫・嫌がらせにあたる内容

- 犯罪や違法行為の相談を含む内容

- 自分や他人を傷つけることをあおる内容

たとえ軽い気持ちでも、誰かを傷つけたり、現実のトラブルや被害につながったりする可能性があります。また、重大な脅威に間しては、アカウントが警告を受け、警察などに通報される可能性もあります。ChatGPTは不満のはけ口ではなく、安全に情報を整理したり考えをまとめたりするための補助ツールとして使うべきです。

ChatGPTを企業利用するときのリスクについては下記で解説

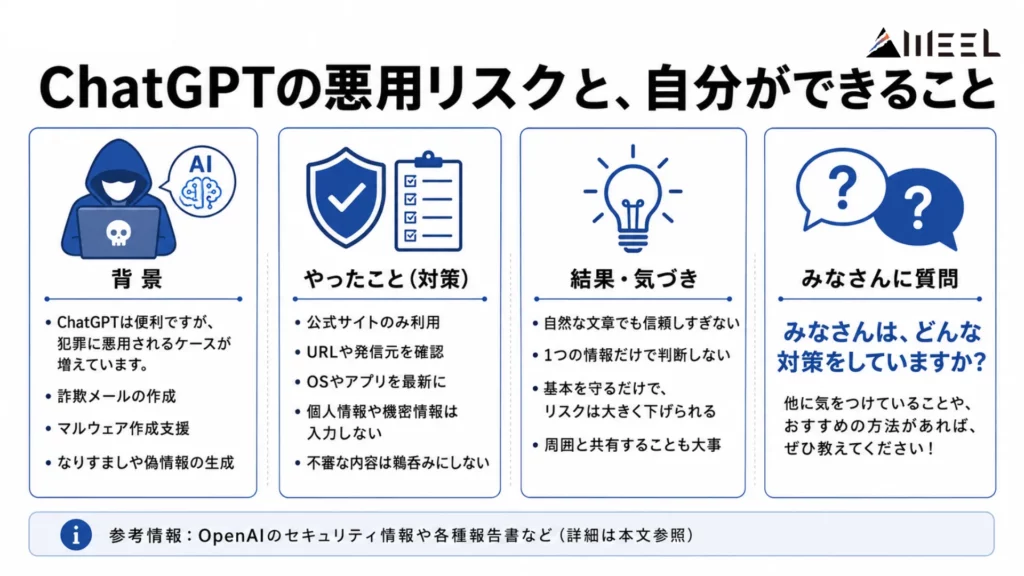

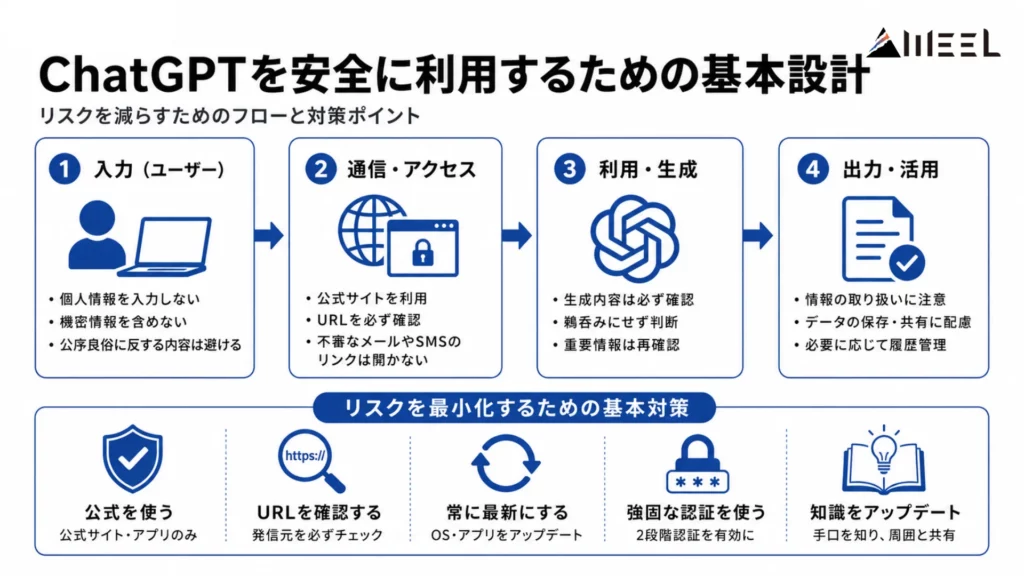

ChatGPTを使った犯罪・不正利用への対策

ChatGPTを安全に使うには、偽サイトや詐欺、情報漏洩といった周辺リスクにも目を向けることが大切です。基本的な対策を知っておくだけでも、被害に遭う可能性は下げられます。

公式サイトを利用する

ChatGPTを使うときは、必ず公式サイトや公式アプリからアクセスするのが基本です。検索結果やSNS広告のリンクなどから入ると、本物そっくりの偽サイトや非公式サービスに誘導されることがあります。

ログイン情報や支払い情報を入力すると、個人情報やクレジットカード情報が盗まれるかもしれません。普段からブックマークしたページを使う、アプリは公式ストアからのみ入手するといった基本動作を徹底するだけでも、不正利用のリスクは大きく下げられます。

発信元のURLを確認する

OpenAIやChatGPTを名乗るメールやSMS、DMが届いても、すぐにリンクを開かないことが重要です。見た目が自然でも、URLが少しだけ違う偽ドメインや、ログイン画面を装ったフィッシングページの可能性があります。

特に、急いで対応させようとする文面ほど注意が必要です。以下のポイントを確認しておきましょう。

- openai.comやchatgpt.comなどの公式ドメインか

- 不自然な文字列や、1文字だけ異なるURLになっていないか

- 短縮URLや転送URLでリンク先が見えにくくなっていないか

少しでも不安がある場合は、届いたリンクを使わず、自分で公式サイトを開き直すほうが安全です。

デバイスを最新バージョンにアップデートする

スマホやパソコン、ブラウザ、アプリを最新の状態に保つことも、セキュリティ対策のひとつです。古いバージョンのままだと、すでに知られている脆弱性を突かれ、不正アクセスやマルウェア感染の被害を受けやすくなります。

ChatGPTを使う端末では、OSやブラウザの更新だけでなく、セキュリティソフトや拡張機能の管理も重要です。自動アップデートを有効にしておけば、更新漏れを防ぎやすくなり、日常的なリスク対策としても有効です。

犯罪・不正利用の手口を知っておく

被害を防ぐには、どのような手口があるのかを事前に知っておくことが大切です。最近はChatGPTを使って自然な日本語の詐欺文面を作成できることもあり、以前より不審点を見抜きにくくなっています。文章が丁寧だから安全とは限らず、むしろ巧妙になっていると考えたほうがよいでしょう。

- 本物そっくりのログイン画面に誘導するフィッシング

- サポート担当者や企業を装ったなりすまし連絡

- 不安をあおって個人情報や支払い情報を入力させる詐欺文面

「今すぐ対応が必要」「アカウント停止」といった急がせる表現が出てきたら、いったん立ち止まって確認する習慣を持つことが重要です。

犯罪・不正利用を検知する仕組みを構築

企業や組織でChatGPTを安全に運用するには、個人の注意やリテラシーに頼るのではなく、組織全体で不正利用を早期に発見する仕組みづくりが不可欠です。例えば、以下のような対策を整えておくと、被害の拡大を防ぎやすくなります。

| 対策 | 内容 |

|---|---|

| 不審ログイン通知 | 見覚えのない端末や場所からのアクセスをすぐ把握する |

| 更新管理 | OS・ブラウザ・アプリを最新状態に保つ |

| 利用状況の確認 | SMS送信数や通信料金の急増を監視する |

| URL対策 | 怪しいリンクや不審サイトへのアクセスを防ぐ |

| 相談体制の整備 | 異常時の相談先を明確にする |

生成AIの社内導入課題について詳しく知りたい方は、下記の記事を合わせてご確認ください。

よくある質問

ChatGPTの犯罪リスクを知り、安全に活用しよう

ChatGPTは文章をまとめるのに便利な反面、犯罪や不正利用の道具として悪用される危険があります。なりすましやフィッシング詐欺の文面作成に加え、不正なプログラム作成の補助にも使われます。

被害を防ぐには、個人情報や機密情報を入力しないように注意し、公式サイトの利用を徹底しましょう。また、企業や組織でも不審なログインを監視する仕組みを整え、全体で対策を進める必要があります。

想定される手口を正しく理解し、トラブルを避けながら安全な運用を心がけてください。

最後に

いかがだったでしょうか?

生成AIは業務効率化に大きく貢献する一方、情報漏洩やフィッシング対策など運用ルールの整備も欠かせません。安全性と利便性を両立しながら、自社に最適な生成AI活用体制を構築できるかが、今後の重要な分岐点になります。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。 ︎株式会社WEELのサービスを詳しく見る。

︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。 ︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、サービス紹介資料もご用意しておりますので、併せてご確認ください。

【監修者】田村 洋樹

株式会社WEELの代表取締役として、AI導入支援や生成AIを活用した業務改革を中心に、アドバイザリー・プロジェクトマネジメント・講演活動など多面的な立場で企業を支援している。

これまでに累計25社以上のAIアドバイザリーを担当し、企業向けセミナーや大学講義を通じて、のべ10,000人を超える受講者に対して実践的な知見を提供。上場企業や国立大学などでの登壇実績も多く、日本HP主催「HP Future Ready AI Conference 2024」や、インテル主催「Intel Connection Japan 2024」など、業界を代表するカンファレンスにも登壇している。

※2:Scores of Stanford students used ChatGPT on final exams, survey suggests

※3:NYC education department blocks ChatGPT on school devices, networks

※4:A Wharton business school professor is requiring his students to use ChatGPT

※6:Disrupting malicious uses of our models: an update February 2025

※7:Fake ChatGPT apps spread Windows and Android malware

※8:チェック・ポイント・リサーチ、サイバー犯罪者によるChatGPTの悪用事例を報告

※9:ChatGPTがもたらすサイバーセキュリティ業界への影響

※10:「快活CLUB」サイバー攻撃、AI悪用し会員情報盗んだ疑いで高2を再逮捕へ…自作プログラムを「チャットGPT」で改善か