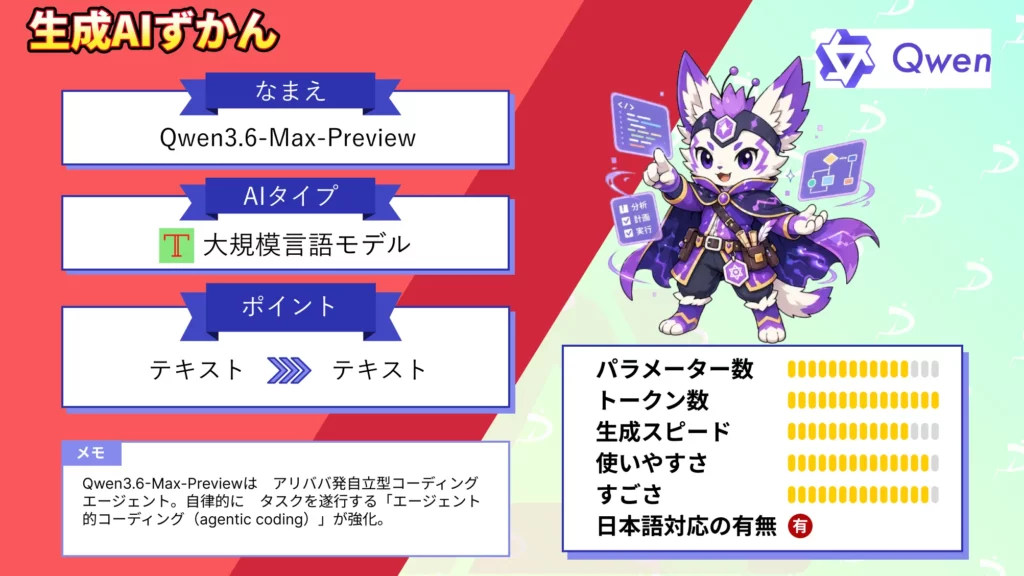

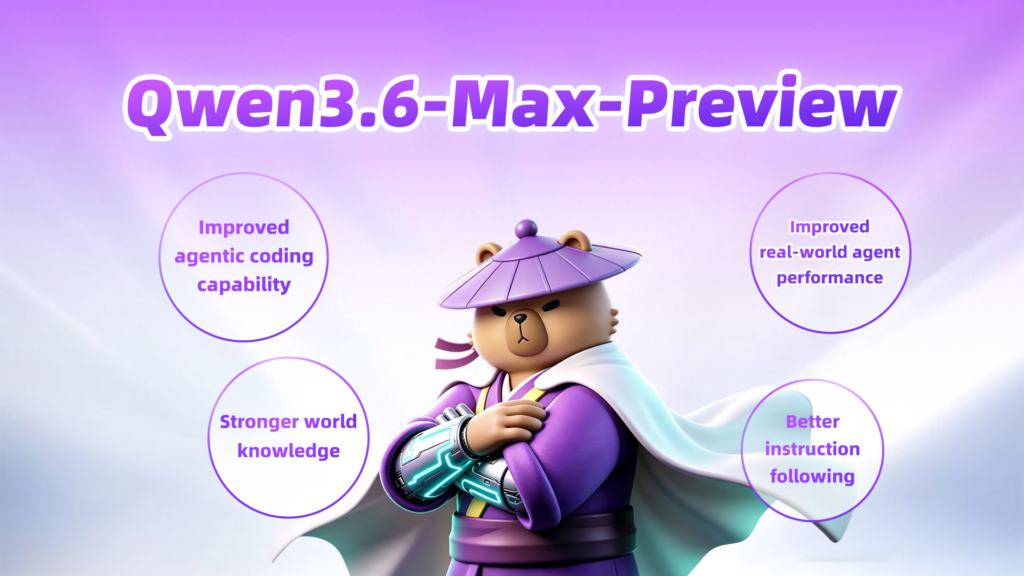

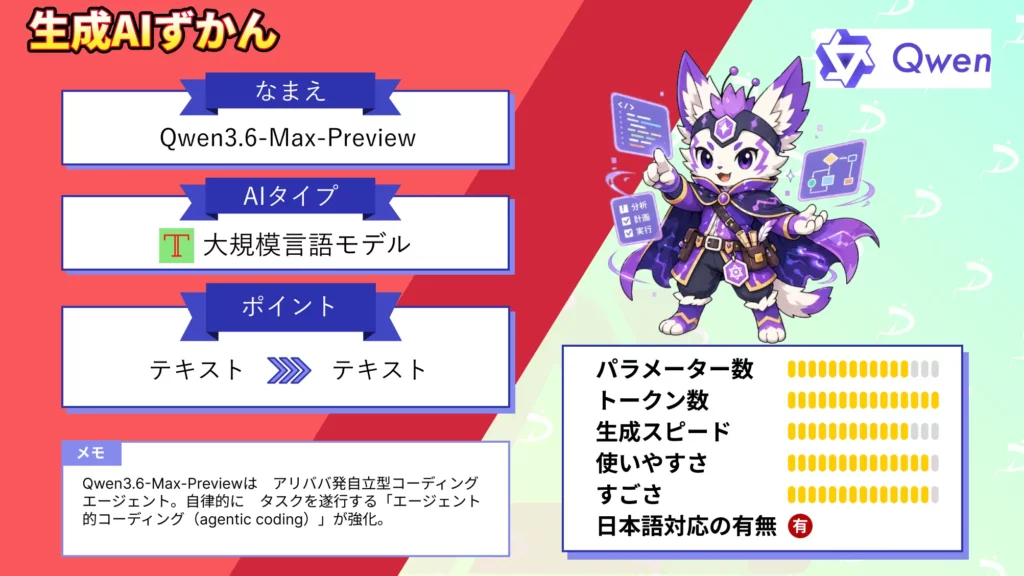

- Qwen3.6-Max-Previewは、アリババ発の自立型コーディングエージェント

- 自律的にタスクを遂行する「エージェント的コーディング(agentic coding)」が強化

- SWE-bench ProやTerminal-Bench 2.0といった6つの主要プログラミングベンチマークで1位を獲得

2026年4月20日、中国のアリババが次世代フラッグシップモデル「Qwen3.6-Max-Preview」をプレビュー版として公開しました!

本モデルは、1兆パラメータ超の巨大スパースMoE構造を採用し、SWE-bench ProやTerminal-Bench 2.0といった6つの主要プログラミングベンチマークで1位を獲得したと公表されています。

そこで本記事では、Qwen3.6-Max-Previewの概要や仕組み、料金、使い方から活用シーンまでを徹底的にに解説します。ぜひ最後までご覧ください!

\生成AIを活用して業務プロセスを自動化/

- Qwen3.6-Max-Previewとは?

- Qwen3.6-Max-Previewの仕組み

- Qwen3.6-Max-Previewの特徴

- Qwen3.6シリーズの比較

- Qwen3.6-Max-Previewの安全性・制約

- Qwen3.6-Max-Previewの料金

- Qwen3.6-Max-Previewのライセンス

- Qwen3.6-Max-Previewの使い方

- 【業界別】Qwen3.6-Max-Previewの活用シーン

- 【課題別】Qwen3.6-Max-Previewが解決できること

- Qwen3.6-Max-PreviewをQwen Studioで使ってみた

- よくある質問

- Qwen3.6-Max-Previewを導入しよう!

- 最後に

Qwen3.6-Max-Previewとは?

Qwen3.6-Max-Previewは、アリババクラウドのQwenチームが公開した、Qwen3.6シリーズの最上位フラッグシップモデルのプレビュー版です。

Qwen3-Maxの技術を継承しつつ、1兆パラメータを超えるMoEアーキテクチャを採用し、最大262,144トークンのコンテキストウィンドウをサポートします。訓練には、36兆トークンという大規模データが用いられ、推論能力を備えた「reasoning model」として分類されています。

注目すべき点は、自律的にタスクを遂行する「エージェント的コーディング(agentic coding)」の強化です。前世代のQwen3.6-Plus比で、プログラミング・世界知識・指令追従のいずれも向上しており、SWE-bench Pro、Terminal-Bench 2.0、SkillsBench、QwenClawBench、QwenWebBench、SciCodeという6つのベンチマークすべてで最高スコアを記録したと公表されています。

Qwen3.6-Plusについて、詳しく知りたい方は以下の記事も参考にしてみてください。

Qwen3.6-Max-Previewの仕組み

Qwen3.6-Max-Previewは、Qwen3-Maxから継承されたトリリオンスケールのスパースMoE構成となっています。

全体では1兆を超えるパラメータを持ちつつ、トークンごとに一部のエキスパートのみをルーティングして活性化させる仕組みにより、巨大モデルながら推論コストを抑えられる設計です。

36兆トークンの事前学習データで基盤能力を積み上げたうえで、エージェント志向の後段学習も加えられています。

Qwen3.6-Max-Previewの特徴

ここからは概要で触れきれなかったベンチマーク数値をもとに、Qwen3.6-Max-Previewの特徴を確認していきましょう。

最大の特徴は、エージェント型コーディングでの圧倒的な伸び率です。前世代Qwen3.6-Plusと比較して、SkillsBenchで+9.9ポイント、SciCodeで+10.8ポイント、Terminal-Bench 2.0で+3.8ポイントの改善が報告されています。

世界知識を問うSuperGPQAは+2.3ポイント、中国語総合知識のQwenChineseBenchは+5.3ポイント上昇し、指令追従のToolcallFormatIFBenchでも+2.8ポイント向上しました。

また、独立系の評価サイトArtificial Analysisにおいては、Intelligence Indexで52ポイントを獲得し、比較可能なモデル201種中2位にランクインしており、同価格帯の推論モデル中央値である14を大きく上回っています。

Qwen3.6シリーズの比較

Qwen3.6ファミリーの中においてのMax-Previewの優位性を確認していきましょう。オープンソースの小型モデルであるQwen3.6-35B-A3B、商用フラッグシップのQwen3.6-Plusと比較して整理します。

| 項目 | Qwen3.6-35B-A3B | Qwen3.6-Plus | Qwen3.6-Max-Preview |

|---|---|---|---|

| 提供形態 | オープンソース(Apache 2.0) | プロプライエタリAPI | プロプライエタリAPI(Preview) |

| アーキテクチャ | MoE(総35B/活性3B) | 線形アテンション+スパースMoEのハイブリッド | スパースMoE(1兆パラメータ超) |

| コンテキスト長 | 262,144(最大約101万まで拡張可) | 約100万トークン | 262,144(約256K) |

| 出力トークン上限 | 非公開 | 最大65,536 | 非公開 |

| SWE-bench Verified | 73.4% | 78.8 | 6大ベンチで最高スコア(Maxシリーズ首位) |

| 主な用途 | ローカル推論・自社ホスト・研究 | 長文/エージェントAPI用途 | 最高難度のエージェントコーディング |

この比較からも分かる通り、Qwen3.6-35B-A3Bは自社環境に持ち込んで細かくチューニングしたい研究・開発者向け、Qwen3.6-Plusは100万トークン級の長文処理が必要な業務APIに強みを持っています。

一方のQwen3.6-Max-Previewは、コンテキスト長こそ256Kに留まるものの、ベンチマークスコアの純粋な高さとエージェント能力で頭ひとつ抜けており、難度の高い自律タスクを任せたいシーンで活躍してくれるでしょう。

Qwen3.6-Max-Previewの安全性・制約

精度の高いQwen3.6-Max-Previewですが、使う前に押さえておきたい注意点もいくつかあります。

本モデルはあくまでプレビュー版なので、継続的に改良が進められる過渡期のバージョンである点は覚えておきましょう。

加えて、重みは非公開のプロプライエタリ提供であるため、オフライン利用や厳密なデータ主権要件には適さない場面もあります。

Qwen3.6-Max-Previewの料金

Qwen3.6-Max-Previewの料金は、アリババクラウドを通じた利用時のトークン単価ベースで設定されています。

| 項目 | 単価(100万トークンあたり) |

|---|---|

| 入力トークン | 6ドル |

| 出力トークン | 24ドル |

| 提供プラットフォーム | アリババクラウド/Qwen Studio |

| API呼び出し名 | qwen3.6-max-preview |

同価格帯の推論モデル群の中では標準〜やや高めの水準にありますが、性能の高さを考慮すれば、1トークンあたりの性能対価格はむしろ優秀な部類だと思います。

Qwen3.6-Max-Previewのライセンス

本モデルは重みを公開しないプロプライエタリモデルとして提供されており、OSSのようにモデル本体を手元に持ち出して改変するといった行為は想定されていません。

あくまで、API経由で推論結果を利用するサービスとして位置づけられる点を前提にご確認ください。

| 利用形態 | 可否(API経由利用時) |

|---|---|

| 商用利用 |  |

| モデル改変(重み編集) |  |

| 再配布(重み再配布) |  |

| 特許利用 | 明示的な許諾なし(Alibaba Cloud規約に従う) |

| 私的利用 |  |

同じQwen3.6ファミリーでも、Qwen3.6-35B-A3BはApache 2.0で公開されており、改変・再配布・特許利用が広く認められている点と対照的です。

Qwen3.6-Max-Previewの使い方

Qwen3.6-Max-Previewの使い方は、ブラウザからの利用と、API経由での利用の2パターンがあるので、目的に合わせて選んでみてください。

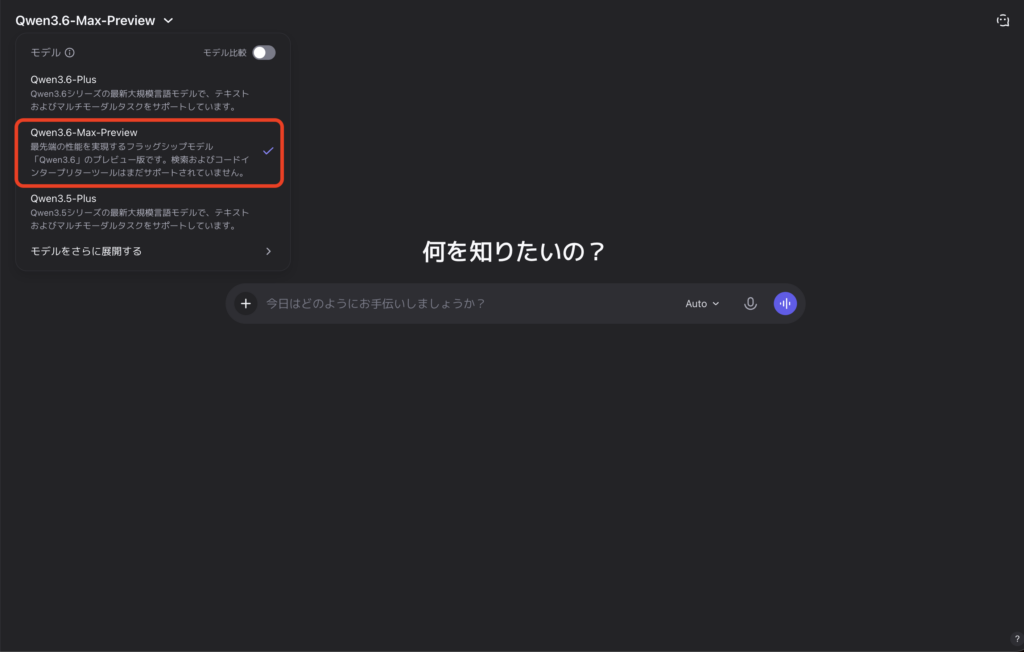

①Qwen Studioからブラウザで試す

一番お手軽なのは、公式WebアプリのQwen Studio(chat.qwen.ai)から利用する方法です。

ブラウザからhttps://chat.qwen.ai/?models=qwen3.6-max-previewにアクセスします。会員登録がまだの方はサインアップしておきましょう。

画面上部のモデル選択から「Qwen3.6-Max-Preview」を選択します。

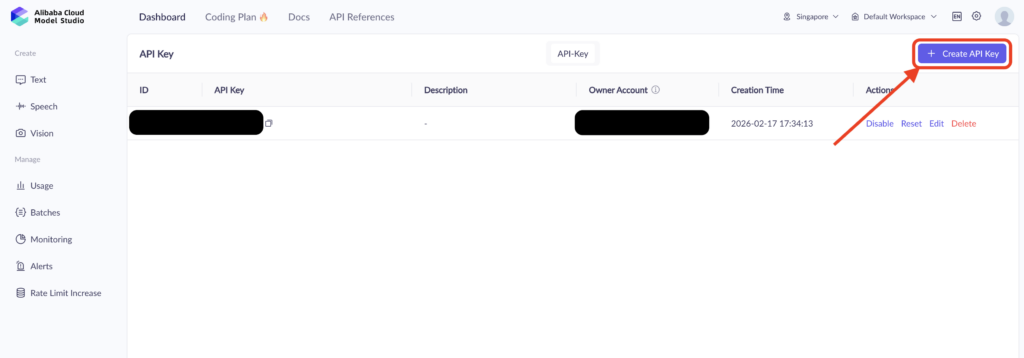

②アリババクラウドAPIから呼び出す

プロダクトに組み込む場合は、API経由が基本ですね。OpenAI互換のエンドポイントが用意されているので、OpenAI SDKのコードをほぼそのまま使うことができます。

クリックで表示

from openai import OpenAI

client = OpenAI(

api_key="YOUR_DASHSCOPE_API_KEY",

base_url="https://dashscope-intl.aliyuncs.com/compatible-mode/v1",

)

response = client.chat.completions.create(

model="qwen3.6-max-preview",

messages=[

{"role": "system", "content": "あなたは優秀なシニアエンジニアです。"},

{"role": "user", "content": "FastAPIでJWT認証を実装する最小コードを書いて。"},

],

)

print(response.choices[0].message.content)OpenAIクライアントの base_url をアリババ互換エンドポイントに書き換えます。

あとは、model に qwen3.6-max-preview を指定してリクエストを投げるだけです。

長めのエージェントタスクでは preserve_thinking 相当のオプションを有効にすると、思考トレースが切れずにツール呼び出しが安定すると思います。

【業界別】Qwen3.6-Max-Previewの活用シーン

ここからは、エージェント型コーディングと長文理解を得意とする本モデルを、各業界でどのように活かせるかという観点で確認していきましょう。

SIer・受託開発業

SWE-bench Proをはじめとする実務的なコーディングベンチで最高スコアを取っている強みから、レガシーコードのリファクタリングや仕様書ベースの新規実装といった受託案件で活躍してくれるでしょう。

チケット管理システムと連携させ、Issueからコード差分までを半自動で生成するといったフローにも適しています。

SaaSプロダクト開発

256KトークンのコンテキストでREADME、設計書、主要モジュールを一括投入できるため、大規模コードベースのオンボーディングや機能追加の設計レビューを効率化できるでしょう。

OpenAI互換APIのおかげで、既存のワークフローへ差し替え検証もスムーズに進めることができます。

生成AIを搭載したSaaSについて、詳しく知りたい方は以下の記事も参考にしてみてください。

教育・研究機関

ベンチマーク「SciCode」でのスコアの高さから分かる通り、科学技術計算のコード生成や論文内アルゴリズムの再現に強みがあります。研究用プロトタイプ作成や、講義のコード演習の自動採点支援といった用途にも向いていますね。

教育業界における生成AI活用について、詳しく知りたい方は以下の記事も参考にしてみてください。

【課題別】Qwen3.6-Max-Previewが解決できること

ここからは現場でよくある課題をベースに、Qwen3.6-Max-Previewが特に活躍してくれるシーンを確認していきましょう。

複雑な自律タスクを任せる

Terminal-Bench 2.0で1位、QwenClawBench・QwenWebBenchでも最高スコアとされる通り、ターミナル操作やWebブラウジングを含む複数ステップの自律タスクで信頼性が高く、人手を介さないRPA的ワークフローの実行役として機能してくれそうです。

長大な資料を一度に要約・分析

Qwen3.6-Max-Previewは、約256Kトークンのコンテキストをサポートしているので、書籍や大規模リポジトリを一気に入力とすることもできます。

議事録や長文契約、巨大コードのレビューなど、これまで分割したり、前処理が必要だった作業をワンショットで処理することができるようになります。

既存SDKやフレームワークを活かしつつ性能を底上げ

OpenAI互換API仕様のおかげで、既存のSDKやエージェントフレームワークをほぼ改修せず差し替えて検証することができます。

モデル切替だけで評価指標が改善するかを短期で確認したいような場面に最適だと思います。

Qwen3.6-Max-PreviewをQwen Studioで使ってみた

それでは実際に、Qwen3.6-Max-PreviewをQwen Studio経由で使っていきます。

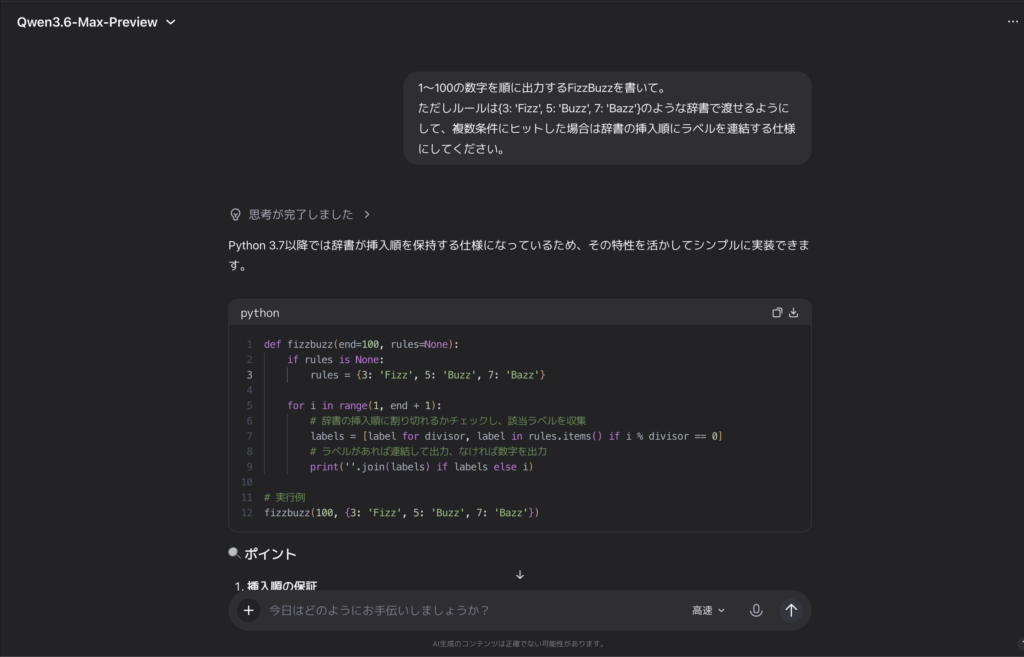

プロンプトはこちら

1〜100の数字を順に出力するFizzBuzzを書いて。

ただしルールは{3: 'Fizz', 5: 'Buzz', 7: 'Bazz'}のような辞書で渡せるようにして、複数条件にヒットした場合は辞書の挿入順にラベルを連結する仕様にしてください。

冒頭で、「Python 3.7以降の辞書は挿入順を保持する」という前提をしてから書き始めているあたり、今回のお題の肝を理解してくれているのが伝わってきますね。続けて、こちらのコードを少し修正してもらいましょう。

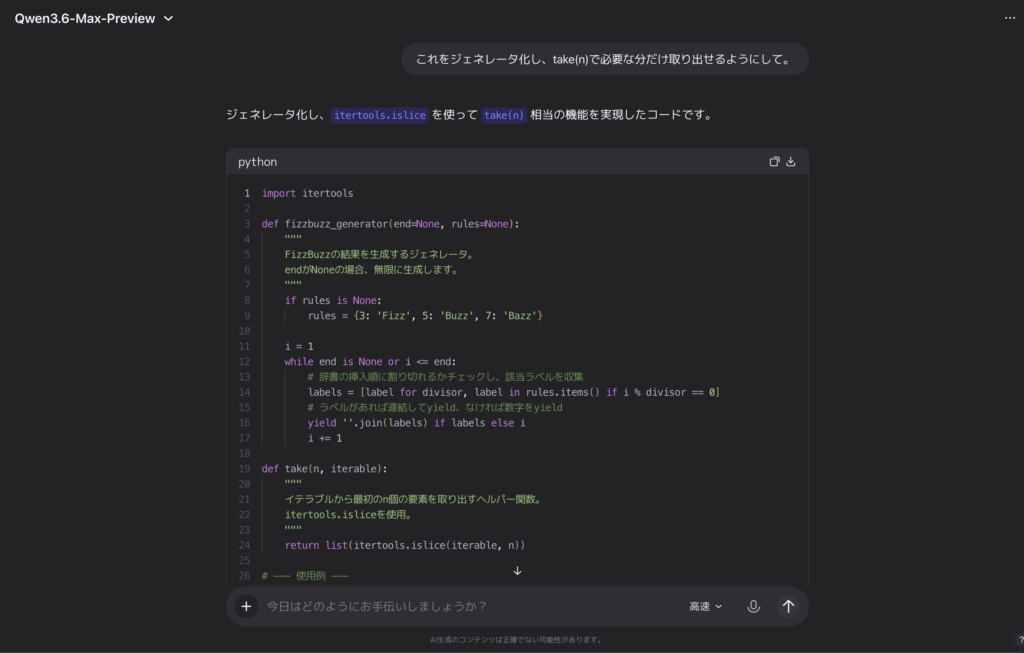

プロンプトはこちら

これをジェネレータ化し、take(n)で必要な分だけ取り出せるようにして。

ジェネレータ化してほしいという曖昧な依頼に対して、プラスアルファで無限長にも対応させてくれていて素晴らしいですね。今回は簡単なコーディングタスクで性能を確認しましたが、大規模コーディングにおいても高い精度で実装してくれると思いますので、気になる方はぜひ試してみてください。

よくある質問

Qwen3.6-Max-Previewを導入しよう!

今回は、2026年4月20日にアリババから公開されたQwen3.6-Max-Previewについて、仕組み・ベンチマーク・料金・ライセンス・使い方まで一通りご紹介してきました。

1兆パラメータ超のスパースMoEと約256Kのロングコンテキストを武器に、SWE-bench ProやTerminal-Bench 2.0を含む6つの主要ベンチマークで1位に立つなど、特にエージェント型コーディングの領域で頭ひとつ抜けた実力を見せてくれたモデルです。

OpenAI/Anthropic互換APIで既存ワークフローに導入しやすい点も、ハードルをぐっと下げてくれますよね。

気になった方は、まずは無料のQwen Studioで感触を確かめてみて、これは仕事で使えると思えたタイミングで百煉APIへ本格的に組み込んでいくのが、一番スムーズで費用対効果の高い進め方かなと思います。

ぜひ一度、試してみてください!

最後に

いかがだったでしょうか?

弊社では、AI導入を検討中の企業向けに、業務効率化や新しい価値創出を支援する情報提供・導入支援を行っています。最新のAIを活用し、効率的な業務改善や高度な分析が可能です。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。 ︎株式会社WEELのサービスを詳しく見る。

︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。 ︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、大規模言語モデル(LLM)を対象に、言語理解能力、生成能力、応答速度の各側面について比較・検証した資料も配布しております。この機会にぜひご活用ください。

Introducing Qwen3.6-Max-Preview, an early preview of our next flagship model

Introducing Qwen3.6-Max-Preview, an early preview of our next flagship model Improved agentic coding capability over Qwen3.6-Plus

Improved agentic coding capability over Qwen3.6-Plus Stronger world knowledge and instruction following

Stronger world knowledge and instruction following Improved real-world agent and knowledge reliability performance

Improved real-world agent and knowledge reliability performance