- Kimi K2.6は、Moonshot AI発の次世代オープンウェイト大規模言語モデル

- 最大300体のサブエージェントで4,000以上のツール呼び出しを12時間自律実行可能なAgent Swarm機能搭載

- SWE-Bench Proで58.6%、Terminal-Bench 2.0で66.7%など、エージェント系ベンチマークでトップクラスのスコア

2026年4月21日、中国のMoonshot AIがフラッグシップ最新モデル「Kimi K2.6」を公開しました!

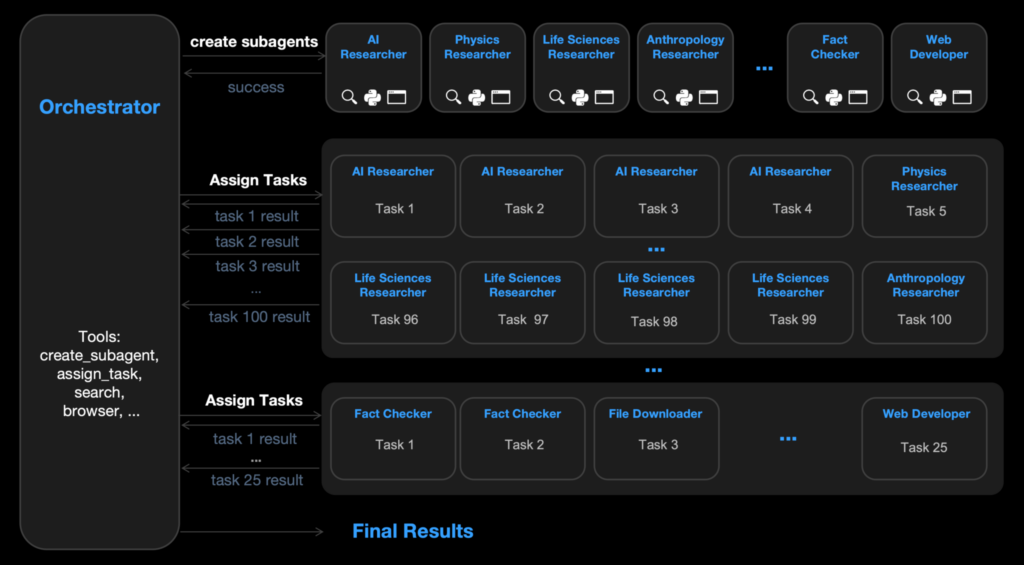

目玉はなんと言っても、最大300体のサブエージェントで、4,000以上のツール呼び出しを12時間ぶっ通しで自律実行できる「Agent Swarm」機能です。しかもライセンスはオープンウェイトのModified MITで、商用利用もハードルが低く設定されています。

そこで本記事では、Kimi K2.6の仕組みや特徴、料金、ライセンス詳細から使い方まで徹底的に解説していきます。ぜひ最後までご覧ください!

\生成AIを活用して業務プロセスを自動化/

Kimi K2.6とは?

Kimi K2.6は、中国発のAIスタートアップMoonshot AIが2026年4月21日にリリースした、オープンウェイトの大規模言語モデルです。

従来モデルKimi K2.5の後継モデルで、コーディング、長期タスクの自律実行、そしてエージェント群による並列処理の3点をコア機能として打ち出しています。

モデルの規模はなんと1兆パラメータ級のMoE(Mixture of Experts)となっています。ただし、推論時に活性化するのはトークンあたり320億パラメータのみで、フロンティア級の知性を、32Bクラスの密モデルに近い推論コストで回せるという効率的な設計になっています。

また、テキストだけでなく画像・動画も入力可能なマルチモーダル対応モデルで、公式ブログでも使えるエージェント基盤であることが強調されています。

KImi K2.5について、詳しく知りたい方は以下の記事も参考にしてみてください。

Kimi K2.6の仕組み

続いて、なぜKimi K2.6が大規模な並列エージェントと長期タスクをこなせるのか、そのアーキテクチャを確認していきましょう。

Kimi K2.6のベースは、1兆パラメータのスパースMoEとネイティブマルチモーダルという構成になっています。

384個のエキスパートのうちトークンごとに8個が動的に選ばれ、加えて常にアクティブな共有エキスパートが1個組み込まれています。注意機構としては、MLA(Multi-head Latent Attention)、活性化関数にはSwiGLUが採用されており、学習安定化のためにMoonshot独自のMuonClipが使われているのも特徴です。

ビジョン側は、4億パラメータのMoonViTと呼ばれる専用エンコーダが担っていて、画像や動画も追加モジュールなしでそのまま入力することができます。

Kimi K2.6の特徴

ここからは、概要で触れきれなかったK2.6ならではのポイントをベンチマーク数値と一緒に見ていきましょう。

一番のポイントは、「Agent Swarm」の設計思想です。

スーパーバイザー1体とワーカー最大300体という形で作られていて、合計4,000回以上のツール呼び出しを12時間ぶっ通しで継続実行できるとされています。前世代のK2.5と比べても、並列実行できるサブエージェント数はおよそ3倍に拡張されていて、長時間タスクの完遂率が強化されました。

ベンチマーク面でも、公式ブログに掲載されている主要なスコアは以下の通りで、エージェント系・コーディング系の指標で軒並み高スコアを出しています。

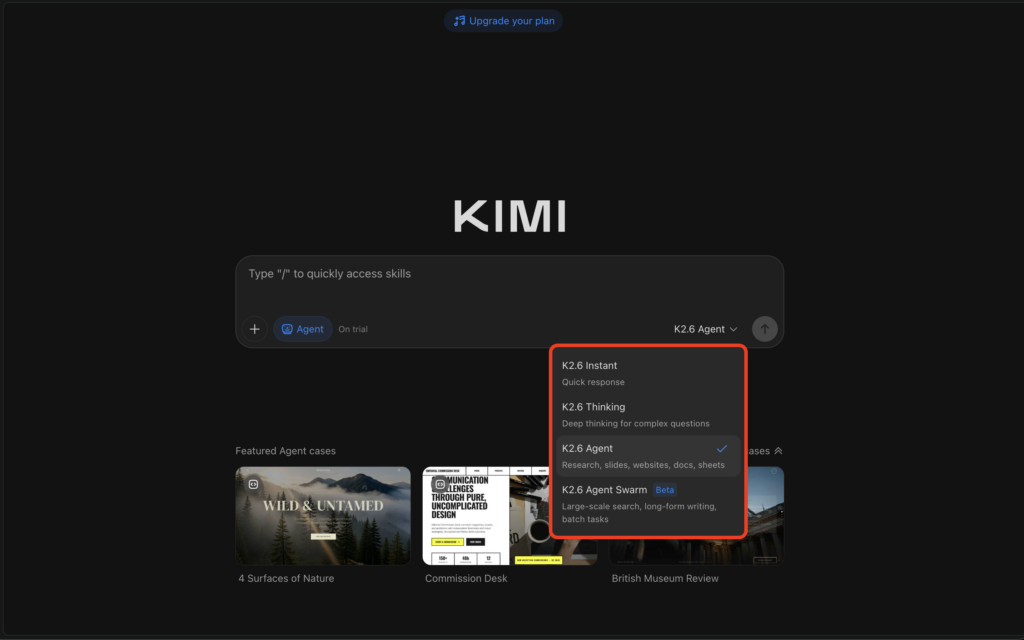

さらに、即時応答(Instant)モード、推論(Thinking)モード、エージェント(Agent)モード、並列実行(Agent Swarm)モードを切り替えられるようになっているのも嬉しいポイントですね。用途に応じて使い分けができるので、コストとレスポンス速度のバランスが取りやすくなっています。

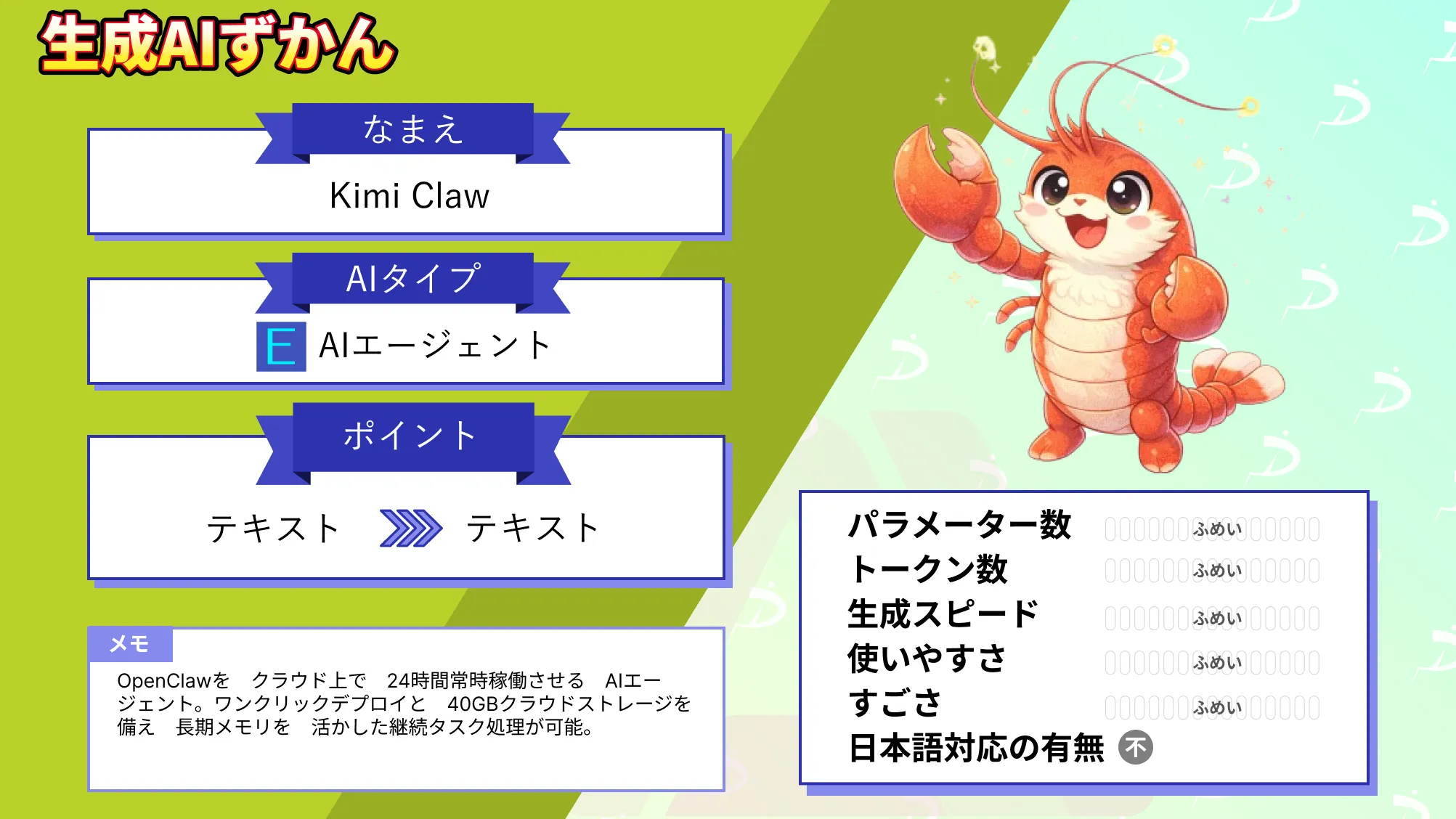

24時間稼働型のAIエージェント「Kimi Claw」について、詳しく知りたい方は以下の記事も参考にしてみてください。

Kimi K2.6の安全性・制約

Kimi K2.6はオープンウェイトではありますが、学習データと学習コードは非公開となっていて、バイアスや知識カットオフに起因するリスクの監査は利用者側で行う必要があります。

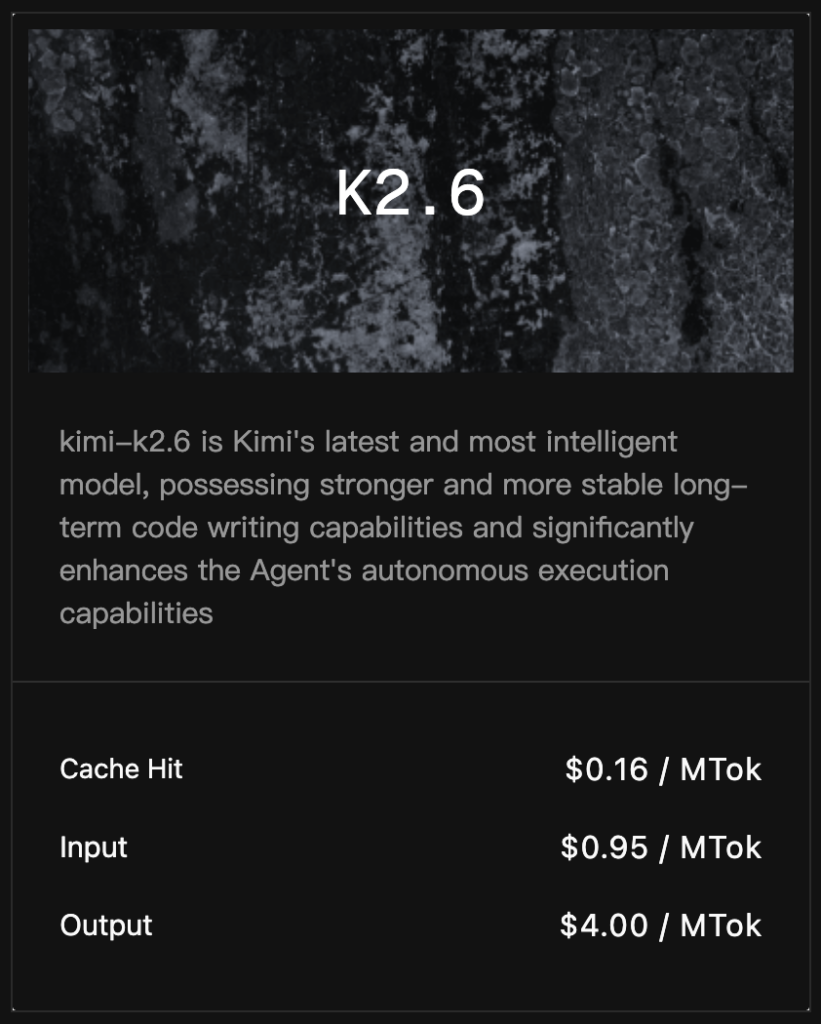

Kimi K2.6の料金

Kimi K2.6は、フロンティアモデルとしてはかなりコスパが良いモデルとなっています。

| 項目 | 単価 |

|---|---|

| 入力トークン | 100万トークンあたり $0.95 |

| 出力トークン | 100万トークンあたり $4.00 |

| Kimi.com/Kimiアプリ | 無料枠あり(超過分は有料プランへ) |

| Kimi Code(開発者向け) | API従量課金と同等 |

Kimi K2.6のライセンス

Kimi K2.6は、オープンウェイトの中でも特に商用利用しやすい条件になっており、SaaSや社内ツールへの組み込みを検討している方には嬉しいライセンスだと思います。

| 利用形態 | 可否 | 備考 |

|---|---|---|

| 商用利用 |  | |

| 改変 |  | |

| 再配布 |  | ライセンス条文の付与が必要 |

| 特許利用 |  | MITライセンス相当の範囲 |

| 私的利用 |  |

Kimi K2.6の使い方

ここからは、Kimi K2.6を実際に使うための手順を、代表的な3つの方法に分けてご紹介します。

①Kimi.com(公式チャット)で試す

1番お手軽なのが、ブラウザ版のKimi.comから触る方法です。

Kimi K2.6には、即時応答(Instant)モード、推論(Thinking)モード、エージェント(Agent)モード、並列実行(Agent Swarm)モードの4つが搭載されていますので、用途に応じて好きなモードを選択しましょう。

②APIから呼び出す

自社アプリやスクリプトで利用する場合は、OpenAI互換のAPIが便利です。以下はPythonでの最小サンプルコードです。

from openai import OpenAI

client = OpenAI(

api_key="YOUR_MOONSHOT_API_KEY",

base_url="https://api.moonshot.ai/v1",

)

resp = client.chat.completions.create(

model="kimi-k2.6",

messages=[

{"role": "system", "content": "You are a senior software engineer."},

{"role": "user", "content": "TypeScriptでLRUキャッシュを実装してください"},

],

)

print(resp.choices[0].message.content)③Hugging Faceからウェイトを取得してセルフホスト

自社のGPU基盤で動かしたい場合は、Hugging Face経由でウェイトをダウンロードする形になります。

pip install -U huggingface_hub vllm

huggingface-cli download moonshotai/Kimi-K2.6 --local-dir ./kimi-k2.6

vllm serve ./kimi-k2.6 --tensor-parallel-size 8 --max-model-len 262144【業界別】Kimi K2.6の活用シーン

Kimi K2.6は、長時間タスクとエージェント群が得意なので、業界ごとに向いている使いどころも分かれてきます。ここからは、代表的な活用シーンを見ていきましょう。

ソフトウェア開発企業

ソフトウェア開発においては、大規模モノレポの自動リファクタリングや、CIで落ちたテストの原因特定から修正PR作成までを、Kimi K2.6のエージェント群にまるごと任せる使い方ができそうです。

262Kコンテキストをサポートしているので、設計書やテスト出力、スタックトレースなどをまとめて入力にすることができる点もありがたいポイントです。

研究機関・大学

研究分野においては、Modified MITのオープンウェイトライセンスを活かして、ベースラインモデルとして論文再現実験に組み込むような活用方法が考えられます。MoEアーキテクチャの学習・推論自体を題材にした研究にも活用できそうです。

教育業界における生成AI活用について、詳しく知りたい方は以下の記事も参考にしてみてください。

エンタープライズ(金融・製造)

金融業や製造業においては、社内のナレッジをRAGで読ませて、長時間稼働のエージェントに帳票整形や議事録要約、システム監査スクリプトの実行までやらせる運用に向いています。

セルフホストできる点も、データ持ち出し制約の厳しい業界にはぴったりハマりますね。

金融業界における生成AI活用について、詳しく知りたい方は以下の記事も参考にしてみてください。

【課題別】Kimi K2.6が解決できること

ここからは、どんな課題を抱えている方にKimi K2.6が有用なのかをまとめていきます。

長時間の自律タスクが途中でストップする課題を解決

従来のLLMでは、4,000ステップ級のエージェントを走らせるとどこかで実行がストップしたり破綻しがちでしたが、Kimi K2.6は、最大300体のサブエージェントと12時間連続実行を前提に設計されているため、長時間にも及ぶワークフローを最後まで完遂させやすくなっています。

巨大なコードベースをまとめて入力

Kimi K2.6の262Kトークンのコンテキストのおかげで、数十万行にも及ぶリポジトリや関連ドキュメントをまとめて入力することができます。分割して入力すると情報が欠損したりすると思いますが、まとめて入力できるので全体の整合性を保ったまま進めることができるようになります。

ランニングコストを抑える

Kimi K2.6は、1兆パラメータ級のMoE(Mixture of Experts)で表現力はキープされつつ、推論時に活性化されるアクティブパラメータは32Bなので、推論コストをグッと抑えることができます。

Kimi K2.6を使ってみた

それでは実際に、Kimi K2.6をKimi公式チャットで試していきます!

検証1:Thinkingモードでポモドーロタイマーを作成

まずは、HTMLファイルで動くポモドーロタイマーをゼロから作ってもらいましょう。推論(Thinking)モードで簡易的に検証していきます。

プロンプトはこちら

HTML、CSS、JavaScriptを1つのファイルにまとめて、

ポモドーロタイマー(25分作業 / 5分休憩)を作ってください。

要件:

- 開始/一時停止/リセットの3ボタン

- 残り時間を円形プログレスで視覚表示

- 作業終了・休憩終了時にブラウザ通知を出す

- モダンでミニマルなデザイン(ダークモード対応)

- 外部ライブラリは使わず、シングルファイルで完結

- コードにはコメントを日本語で添えるKimi K2.6は、pomodoro_timer.htmlというファイルを生成し、右側のプレビューにそのまま動くUIを表示してくれました。

深い青系グラデーションの背景に、25分カウントの円形が配置され、「開始」「リセット」ボタンと「通知を許可する」ボタンまでしっかり揃えてくれています。完了セッションのカウンターも実装されていて、指示していない細かい部分まで気を利かせてくれているのが印象的です。

検証2:Agentモードで簡単な資料作成

続いては、リサーチから資料化までを一気通貫でお願いしてみましょう。Agentモードで検証します。

プロンプトはこちら

「生成AIを社内導入する際のチェックポイント」をテーマに、

上司にそのまま提出できる1枚サマリー資料を作成してください。

要件:

- A4縦1枚に収まる分量

- 「導入目的 / 想定ユースケース / リスクと対策 / 導入ステップ / KPI」の5セクション構成

- 各セクションは箇条書き3〜5項目で簡潔に

- 最後に意思決定者向けの「次のアクション」を3つ提示

- Markdown形式で出力Kimi K2.6は要件通りに「導入目的/ユースケース/リスクと対策/導入ステップ/KPI」の5セクションをきっちり揃えたうえで、最後に意思決定者向けのネクストアクションを3つ提示してくれました。

ただ並べるだけでなく、具体的な数値を提示してくれているのもポイントが高いですね。例えば、ユースケースには「文書作成 30〜50%短縮」といった期待効果、KPIには「3ヶ月後60%→6ヶ月後80%のアクティブ利用率」「12ヶ月以内に黒字化」といった具体的な目標値まで添えてくれています。

よくある質問

最後に、Kimi K2.6について、多くの方が気になるであろう質問とその回答をご紹介します。

Kimi K2.6を活用しよう!

Kimi K2.6は、1兆パラメータMoEをベースに、300体のエージェント群で最大12時間自律実行可能なオープンウェイトLLMです。

SWE-Bench ProやTerminal-Bench 2.0で高いスコアを叩き出しながら、API単価は安めに抑えられていて、個人開発者から大企業まで幅広くフィットする存在になっています。

エージェント時代に活用できる大規模言語モデルをお探しの方はぜひ一度試してみてください!

最後に

いかがだったでしょうか?

弊社では、AI導入を検討中の企業向けに、業務効率化や新しい価値創出を支援する情報提供・導入支援を行っています。最新のAIを活用し、効率的な業務改善や高度な分析が可能です。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。 ︎株式会社WEELのサービスを詳しく見る。

︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。 ︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、大規模言語モデル(LLM)を対象に、言語理解能力、生成能力、応答速度の各側面について比較・検証した資料も配布しております。この機会にぜひご活用ください。

Open-source SOTA on HLE w/ tools (54.0), SWE-Bench Pro (58.6), SWE-bench Multilingual (76.7), BrowseComp (83.2), Toolathlon (50.0), Charxiv w/ python(86.7), Math Vision w/ python (93.2)

Open-source SOTA on HLE w/ tools (54.0), SWE-Bench Pro (58.6), SWE-bench Multilingual (76.7), BrowseComp (83.2), Toolathlon (50.0), Charxiv w/ python(86.7), Math Vision w/ python (93.2)