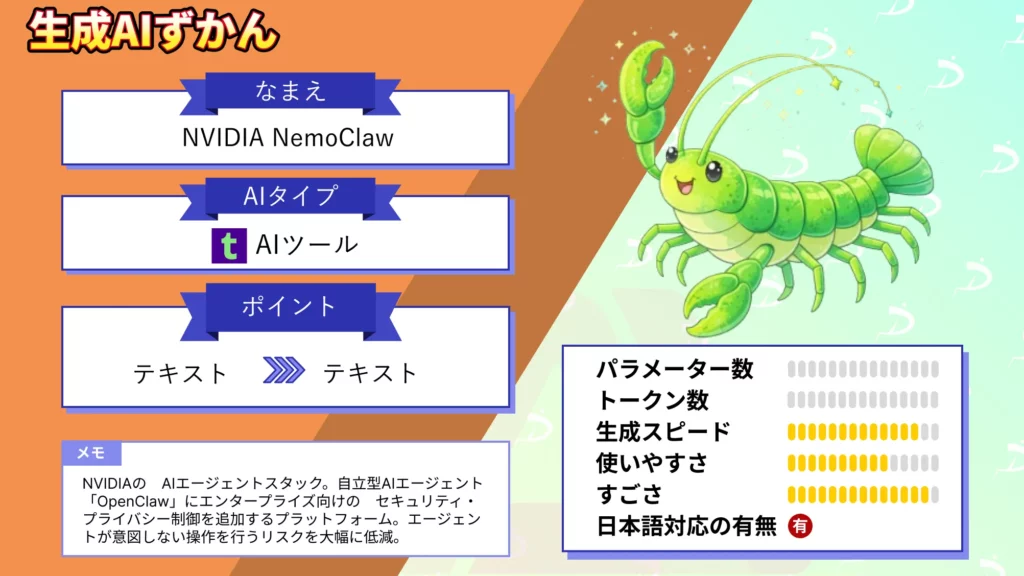

- NVIDIAがGTC 2026の基調講演で発表したオープンソースのAIエージェントスタック

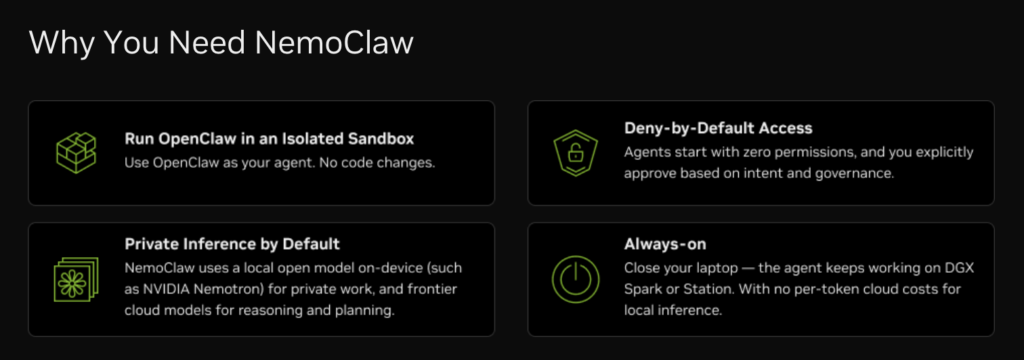

- 自立型AIエージェント「OpenClaw」にエンタープライズ向けのセキュリティ・プライバシー制御を追加するプラットフォーム

- NVIDIA OpenShellランタイムを統合し、エージェントが意図しない操作を行うリスクを大幅に低減

2026年3月17日、NVIDIAがGTC 2026の基調講演にて、オープンソースのAIエージェントスタック「NVIDIA NemoClaw」を正式に発表しました!

NemoClawは、GitHubで30万スター以上を獲得し爆発的に普及した自律型AIエージェント「OpenClaw」に、エンタープライズ向けのセキュリティ・プライバシー制御を追加するプラットフォームです。

CEOのJensen Huang氏は基調講演において、OpenClawを「パーソナルAIのオペレーティングシステム」と位置づけた上で、NemoClawの投入を発表しています。

そこで本記事では、NemoClawの概要から仕組み、使い方、活用シーンまで、徹底的に解説していきます。

ぜひ最後までご覧ください!

\生成AIを活用して業務プロセスを自動化/

NVIDIA NemoClawとは?

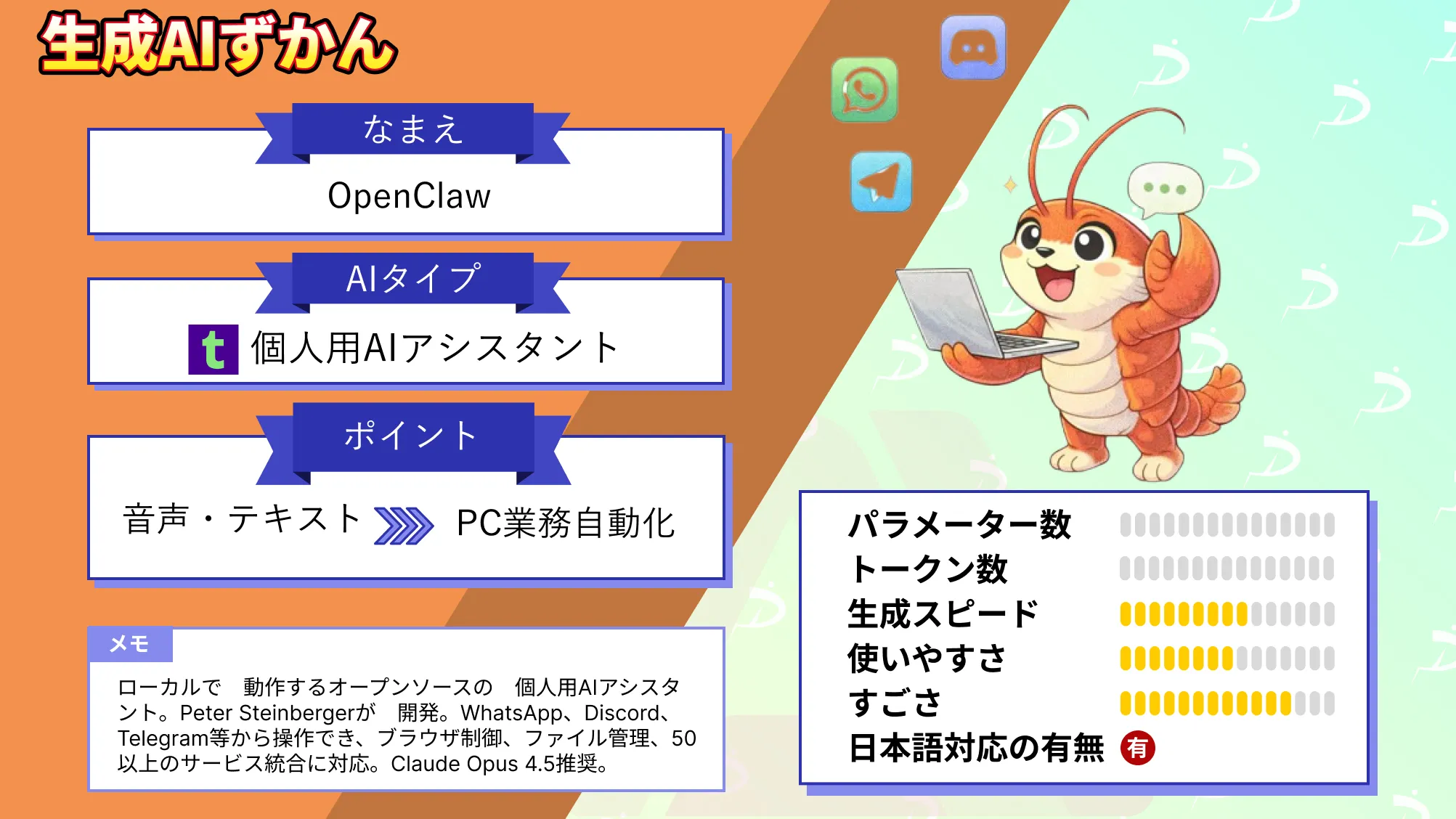

NVIDIA NemoClawは、自律型AIエージェントプラットフォーム「OpenClaw」をより安全かつ簡単にデプロイするためのオープンソーススタックです。簡単に言い換えると、OpenClawにNVIDIA独自のセキュリティ基盤を組み合わせた「エンタープライズ版OpenClaw」のような存在です。

OpenClawは、自然言語の指示だけでPCを自律的に操作できるAIエージェントとして急速に普及しましたが、セキュリティ面での課題が指摘されていました。

NemoClawはこの課題に対して、NVIDIA OpenShellランタイムを統合することで、サンドボックス化された実行環境を提供します。エージェントのネットワーク通信、ファイルアクセス、推論呼び出しのすべてがポリシーベースで制御されるため、エージェントが意図しない操作を行うリスクを大幅に低減できます。

推論エンジンとしては、NVIDIAのオープンモデル「Nemotron 3 Super 120B」をはじめとするモデルをサポートしており、ローカルGPU上での推論とクラウド経由の推論をプライバシールーターで使い分けることができます。

なお、OpenClawについて、詳しく知りたい方は以下の記事も参考にしてみてください。

NVIDIA NemoClawの仕組み

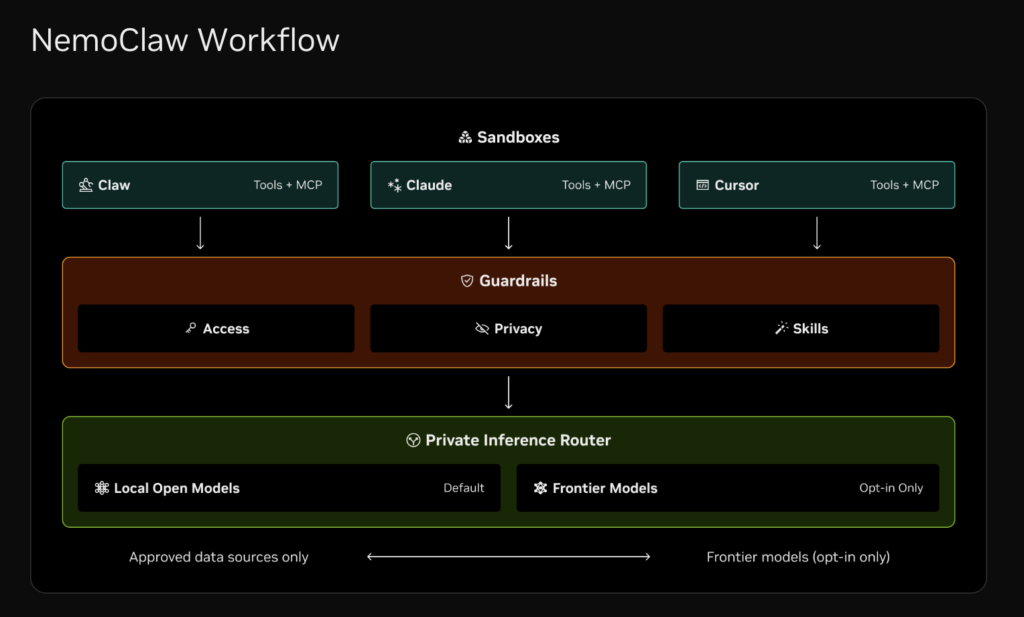

NemoClawのアーキテクチャは、複数のレイヤーが連携することでセキュアなエージェント実行を実現しています。こちらでは、その構成モジュールと動作原理を整理していきましょう。

NemoClawは、以下の表の通り、大きく4つのコンポーネントで構成されています。

| コンポーネント | 役割 | 技術スタック |

|---|---|---|

| Plugin | CLIによるエージェントの起動・接続・ログ管理 | TypeScript |

| Blueprint | サンドボックスとポリシーのセットアップを行うオーケストレーター | Python |

| Sandbox | ポリシーが適用された隔離コンテナ内でOpenClawを実行 | Landlock, seccomp, ネットワーク名前空間 |

| Inference | NVIDIA クラウドまたはローカルvLLM経由でのモデル推論 | OpenShellゲートウェイ |

動作の流れとしては、まずPluginがCLIからユーザーの操作を受け付け、Blueprintがサンドボックス環境を構築します。Sandboxの内部ではOpenClawエージェントが動作しますが、すべてのネットワーク通信やファイルアクセスはポリシーエンジンによって検査され、許可されたものだけが実行されます。

特に重要なのが、OpenShellが採用する「アウトオブプロセス型ポリシー適用」という設計思想です。従来のようにエージェント内部にプロンプトでルールを埋め込むのではなく、エージェントの外側でポリシーを強制するため、たとえエージェントが侵害されてもポリシーが回避されることはありません。ブラウザのタブ分離モデルに近い考え方で、セッションごとに権限が検証される仕組みになっています。

さらに、プライバシールーターが推論リクエストの振り分けを担当します。機密性の高いデータはローカルのNemotronモデルで処理し、必要に応じてクラウド上のフロンティアモデルに問い合わせる、といったハイブリッドなアプローチが採られています。

NVIDIA NemoClawの特徴

NemoClawが他のAIエージェント基盤と比較して際立っている点を、技術的な観点から掘り下げてみましょう。

まず注目すべきは、4層のセキュリティ保護です。ネットワーク層では、ホットリロード可能なアウトバウンド通信制限、ファイルシステム層では/sandboxと/tmpのみへのアクセス制限、プロセス層では特権昇格の防止と制限されたシステムコールの適用、推論層ではすべてのモデルAPI呼び出しを制御されたバックエンドにルーティングする仕組みが実装されています。

これらは、deny-by-default(デフォルトで拒否)のポリシーで運用され、ライブアップデートと完全な監査証跡がプラットフォーム全体にわたって提供されます。

また、推論エンジンとして採用されているNemotron 3 Super 120Bも強力です。

120Bのパラメータ総数に対して、12Bのアクティブパラメータで動作するMixture of Experts(MoE)アーキテクチャを採用しており、100万トークンのコンテキストウィンドウを備えています。

公式ベンチマークでは、PinchBench(OpenClawエージェント評価)で85.6%とオープンモデル最高水準を達成し、SWE-Bench Verifiedで60.47%、GPQAで79.23%(ツール利用時は82.70%)を記録しています。推論スループットについても、GPT-OSS-120Bと比較して最大2.2倍、Qwen3.5-122Bとの比較では最大7.5倍の高速化を実現しています。

そして、NemoClawの設計上の大きな特徴として、エージェントフレームワークに依存しない点が挙げられます。OpenClawだけでなく、Claude CodeやCodexなどのエージェントも、コードの変更なしでNemoClawのセキュリティ基盤上で実行可能となっています。

なお、GPT-5.3-Codexについて、詳しく知りたい方は以下の記事も参考にしてみてください。

NVIDIA NemoClawの安全性・制約

NemoClawはセキュリティに力を入れたプラットフォームですが、導入前に理解しておくべき制約もあります。

2026年3月17日時点で、NemoClawはアルファ段階のプロジェクトであり、インターフェースや動作仕様が変更される可能性があります。

公式GitHubリポジトリにも明記されている通り、本番環境へのデプロイはまだ推奨されていません。セキュリティ機構自体は堅牢な設計ですが、エンタープライズでの大規模運用を想定する場合は、今後のアップデートを注視する必要があります。

NVIDIA NemoClawの料金

NemoClawの料金体系は、ソフトウェア自体のコストと推論APIの利用料金に分けて理解しておくと良いでしょう。NemoClaw本体は、Apache 2.0ライセンスのオープンソースソフトウェアであり、ダウンロードやインストールに費用はかかりません。ただし、クラウド推論を利用する場合は、推論エンジンの利用料が発生します。

| 項目 | 料金 |

|---|---|

| NemoClaw本体(ソフトウェア) | 無料(Apache 2.0 OSS) |

| Nemotron 3 Super 120B 推論(入力) | $0.20 / 100万トークン |

| Nemotron 3 Super 120B 推論(出力) | $0.80 / 100万トークン |

| ローカルvLLM推論 | 無料(自前GPU利用) |

| ローカルNIM推論 | 無料(自前GPU利用) |

NemoClawをローカル環境のみで運用する場合は、ハードウェア費用以外のランニングコストは発生しません。

一方、クラウド推論を利用する場合でも、Nemotron 3 Superの料金は入力0.20/100万トークン、出力0.20/100万トークン、出力0.80/100万トークンと、同規模のモデルと比較しても優しめの価格設定になっています。

NVIDIA NemoClawのライセンス

NemoClaw本体およびNVIDIA OpenShellは、いずれもApache License 2.0のもとで公開されています。

| 利用形態 | 可否 |

|---|---|

| 商用利用 |  |

| 改変(修正・カスタマイズ) |  |

| 再配布 |  (著作権表示とライセンス文の同梱が必要) (著作権表示とライセンス文の同梱が必要) |

| 特許利用 |  (Apache 2.0に特許許諾条項あり) (Apache 2.0に特許許諾条項あり) |

| 私的利用 |  |

Apache 2.0ライセンスは、OSSライセンスの中でも特にビジネス利用に適したライセンスのひとつです。改変したソースコードを公開する義務がなく、プロプライエタリな製品への組み込みも許可されています。

NVIDIA NemoClawの使い方

ここからは、実際にNemoClawをセットアップしてAIエージェントを動かすまでの手順を解説していきます。NemoClawにはクラウド推論を利用するプロファイルと、ローカル推論を利用するプロファイルがあるため、それぞれの方法を紹介します。

NVIDIA APIを使ったクラウド推論での起動(Productionプロファイル)

1番お手軽に始められる方法です。NVIDIA APIキーを取得し、クラウド上のNemotron 3 Superモデルを利用します。

前提条件の確認

以下の環境が必要です。

- Ubuntu 22.04 LTS以降

- Node.js 20以上、npm 10以上

- Docker

NemoClawをインストールする

ターミナルで以下のコマンドを実行します。

curl -fsSL https://nvidia.com/nemoclaw.sh | bash初期セットアップを行う

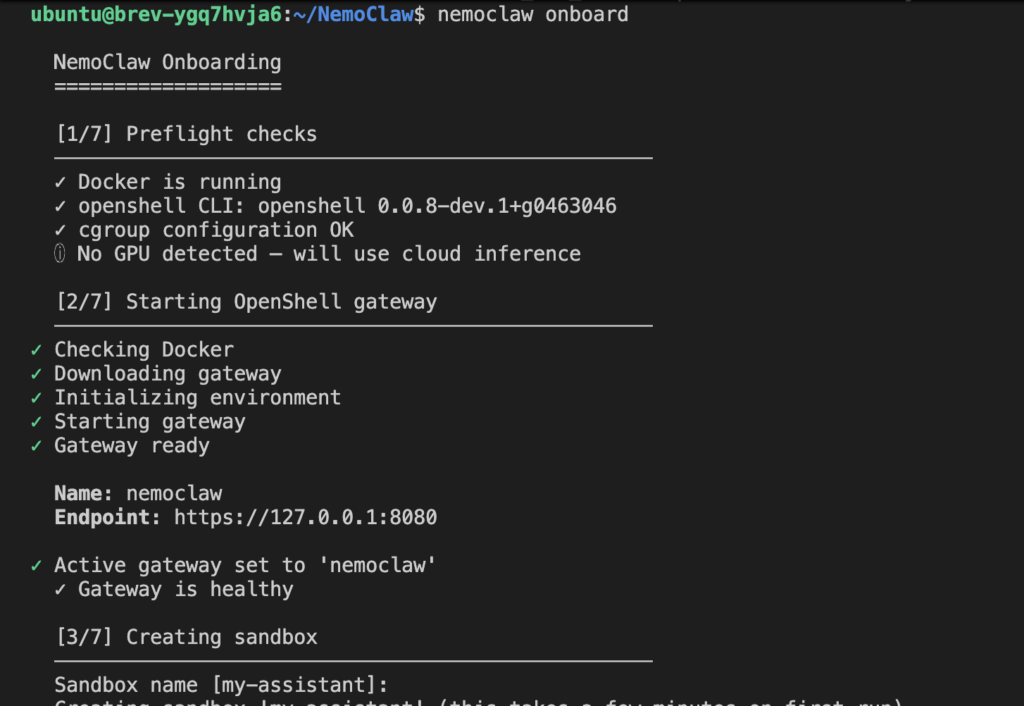

インストールが完了したら、オンボーディングウィザードを起動します。

nemoclaw onboardウィザードの画面指示に従って、使用するプロファイルや基本設定を入力します。

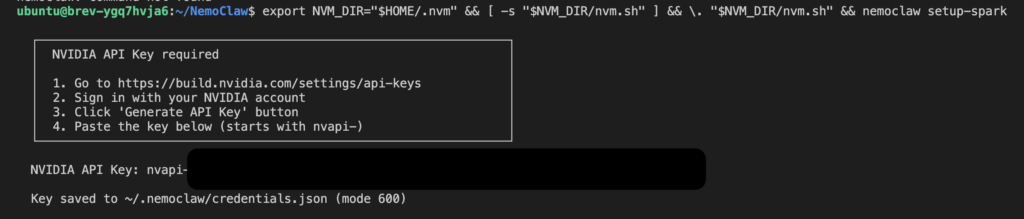

NVIDIA APIキーを取得する

build.nvidia.com にアクセスし、Nemotron 3 Super 120BのページからAPIキーを発行します。取得したAPIキーを環境変数に設定します。

export NVIDIA_API_KEY="your-api-key-here"エージェントを起動する

以下のコマンドでサンドボックス化されたOpenClawエージェントに接続できます。

nemoclaw my-assistant connectこれで、セキュアなサンドボックス内でOpenClawエージェントが稼働し、自然言語での指示を受け付ける状態になります。

ローカルvLLMでの起動(Local developmentプロファイル)

自前のGPU環境でモデルをローカル実行する方法です。プライバシーを最大限に確保したい場合に適しています。

NemoClawのインストール

Productionプロファイルと同様に、以下のコマンドでインストールします。

curl -fsSL https://nvidia.com/nemoclaw.sh | bashオンボーディングでローカルプロファイルを選択

nemoclaw onboardウィザードでLocal developmentプロファイルを選択します。この場合、vLLMがホスト上でNemotronモデルを実行します。

エージェントの起動とモニタリング

nemoclaw my-assistant connectローカル推論では、すべてのデータが自分のマシン上で処理されるため、機密情報を扱う用途にも安心して利用できます。モニタリングにはOpenShellのターミナルインターフェースが使えます。

openshell term主要CLIコマンド一覧

日常的に使用するコマンドをまとめておきます。

# エージェントのヘルスチェック

openclaw nemoclaw status

# ログのストリーミング

openclaw nemoclaw logs

# エージェントの起動(ブートストラップ)

openclaw nemoclaw launch【業界別】NVIDIA NemoClawの活用シーン

NemoClawはさまざまな業界で活用が見込まれています。こちらでは、特にNemoClawのセキュリティ機能とエージェント自律性が活きるユースケースを業界ごとに見ていきましょう。

金融業界

金融業界では、顧客データや取引情報の機密性が極めて高く、AIエージェントの導入に慎重な姿勢が取られてきました。

NemoClawのサンドボックス実行とプライバシールーターを活用すれば、機密データをローカルで処理しつつ、複雑な分析タスクにはクラウドモデルを安全に併用するという運用が可能になるかと思います。定型的なレポート作成や市場データの収集・要約といった業務に、セキュリティポリシーを適用した状態で自律的なエージェントを投入できます。

なお、金融業界における生成AI活用について、詳しく知りたい方は以下の記事も参考にしてみてください。

ヘルスケア・医療

患者データを取り扱う医療分野では、データの外部送信に対する規制が非常に厳格です。

NemoClawのローカル推論プロファイルを使えば、すべてのデータ処理をオンプレミスで完結させることができ、HIPAA等のコンプライアンス要件にも対応しやすくなります。医療文書の整理や研究論文のサーベイなど、定常的な作業を自動化する用途に適しています。

なお、医療業界における生成AI活用について、詳しく知りたい方は以下の記事も参考にしてみてください。

ソフトウェア開発

開発チームでは、コードレビューの補助、テストの自動実行、ドキュメント生成といったタスクにNemoClawを活用できます。

Nemotron 3 SuperがSWE-Benchで60.47%のスコアを達成していることからもわかるように、ソフトウェアエンジニアリングタスクにおける実力は十分です。

NemoClawのセキュリティ基盤の上で動かすことで、プロプライエタリなコードベースへのアクセスを制御しながら開発生産性を向上させることができるかと思います。

【課題別】NVIDIA NemoClawが解決できること

ここでは、企業がAIエージェントを導入する際に直面しがちな課題と、NemoClawがそれをどう解決するかを整理します。

AIエージェントのセキュリティリスクを排除

自律型AIエージェントは強力な反面、意図しないネットワーク通信やファイル操作を行うリスクがあります。

NemoClawは、エージェントの外側でポリシーを強制するアウトオブプロセス型の設計を採用しているため、エージェント内部のプロンプトインジェクション攻撃などでポリシーが回避されることがありません。deny-by-defaultのネットワークポリシーにより、許可されていない通信は一切行われません。

なお、Anthropic社が出している脆弱性検知機能「Claude Code Security」について、詳しく知りたい方は以下の記事も参考にしてみてください。

機密データをクラウドに送信せずにAIを活用

NemoClawのプライバシールーターは、データの機密レベルに応じてローカル推論とクラウド推論を自動的に使い分けてくれます。

機密性の高いコンテキストは、デバイス上のNemotronモデルで処理し、そうでないタスクのみクラウドのフロンティアモデルにルーティングするため、データ漏洩リスクを最小限に抑えながらAIの性能を最大限に引き出せます。

エージェントの行動を監査・追跡

NemoClawは、すべてのエージェントアクションに対して完全な監査証跡を提供します。どのネットワーク通信が行われたか、どのファイルにアクセスしたか、どの推論リクエストが発行されたかをすべて記録・追跡できるため、規制産業でのコンプライアンス対応にも耐えうる透明性を実現しています。

NVIDIA NemoClawを使ってみた

ここからは、実際にNemoClawをセットアップして検証した結果をお伝えします。

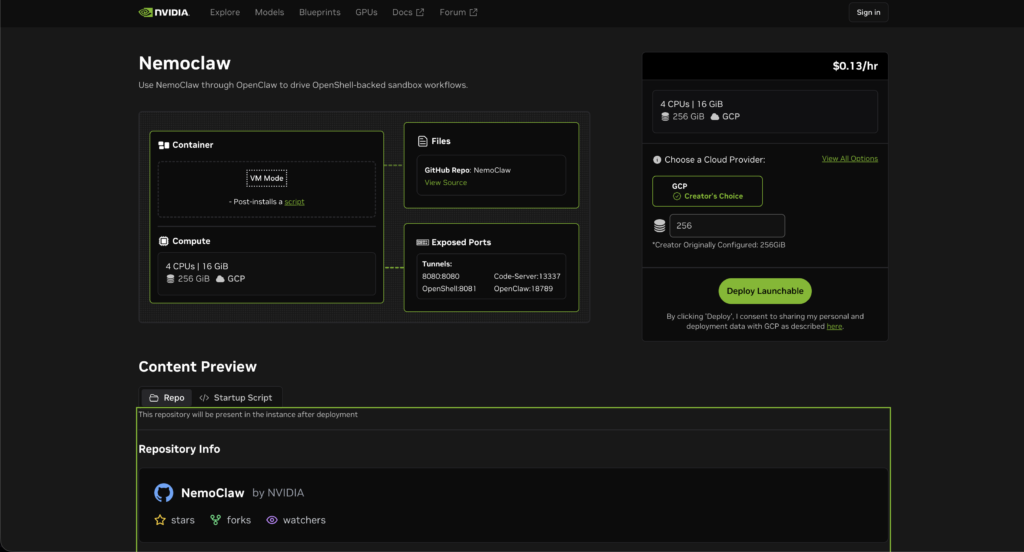

NemoClawのローカルインストールはUbuntu 22.04 LTS以降が必要ですが、今回はmacOS環境からNVIDIA BrevのクラウドGPUインスタンスを利用して検証を行いました。Macユーザーの方でもこの方法なら手軽に試せるので、ぜひ参考にしてみてください。

Brev経由でのセットアップ

まず、NVIDIA公式が用意しているBrevのワンクリックデプロイURLにMacのブラウザからアクセスします。

アクセスすると、NemoClawがプリインストールされたGPUインスタンスの起動画面が表示されます。インスタンスを起動すると、ブラウザ上のターミナル、もしくはVS Code Remote SSH経由でクラウド上のUbuntu環境に接続でき、あとはローカルと同じ感覚で操作できます。

nemoclaw onboard

オンボーディングウィザードが起動するので、画面の指示に従ってプロファイルを選択します。今回はクラウド推論(Nemotron 3 Super 120B)を使うProductionプロファイルを選びました。build.nvidia.comで取得したAPIキーを設定し、エージェントに接続します。

Brevのおかげで環境構築にほとんど時間がかからず、Mac上のブラウザだけで数分でNemoClawの動作環境が整いました。Ubuntuマシンを自前で用意する必要がないのは、検証目的ではかなりありがたいポイントです。

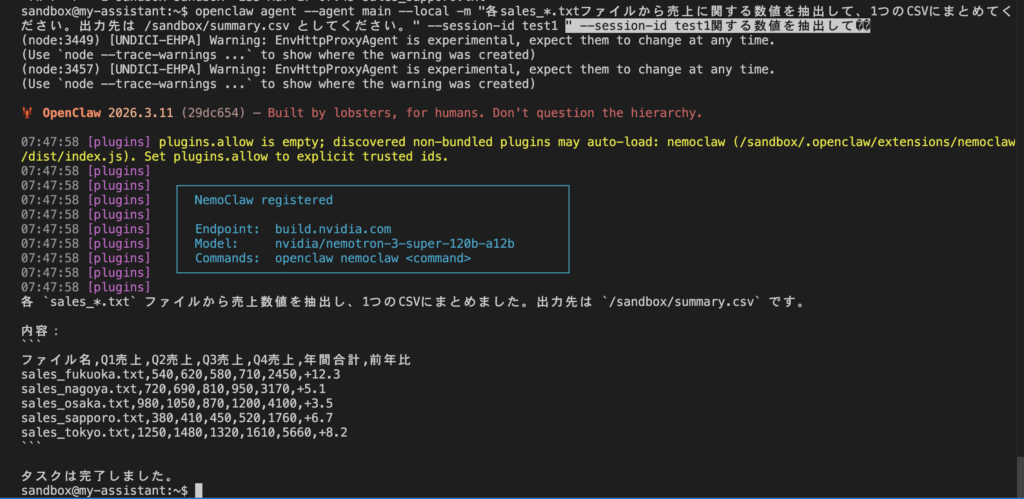

検証1:ファイル操作タスクでサンドボックスの挙動を確認

最初に試したのは、サンドボックスの制御がきちんと機能しているかの検証です。Brev上のインスタンスにいくつかのサンプルテキストファイルを配置し、「各ファイルから売上に関する数値を抽出して、1つのCSVにまとめてください」と自然言語で指示しました。

エージェントは/sandboxディレクトリ内の5つのテキストファイルを順に読み込み、各支店のQ1〜Q4売上・年間合計・前年比をすべて正確に抽出して、/sandbox/summary.csvにまとめてくれました。

日本語のファイルも問題なく処理され、数値の万円単位も正しく認識しています。なお、途中でサンドボックス内から/home/ubuntu/にアクセスしようとした際に「No such file or directory」と表示されたのですが、サンドボックスからはホスト側のファイルシステムが完全に隔離されていることが分かりますね。

エージェントの「行動範囲」がOSレベルで確実に管理されていることを、セットアップの過程で身をもって体感できました。

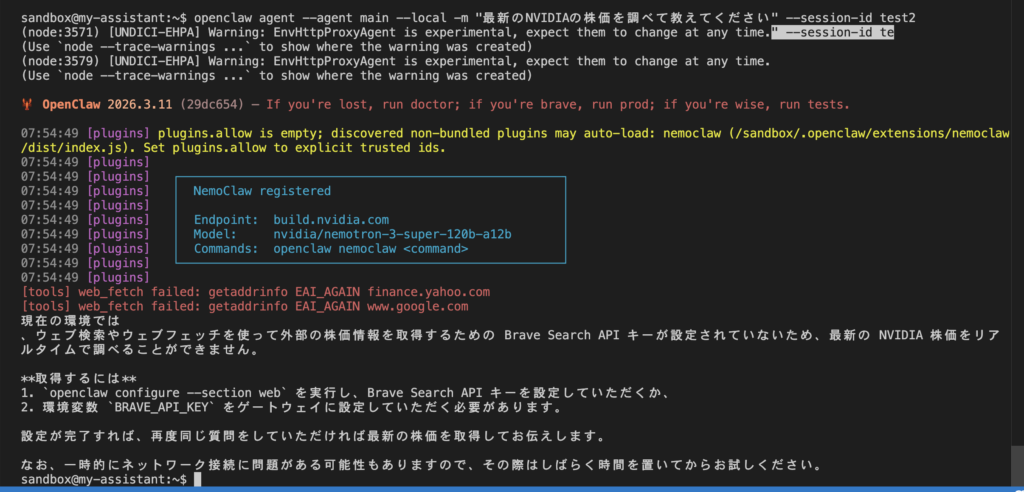

検証2:ネットワークポリシーの制御を体験

次に、「最新のNVIDIAの株価を調べて教えてください」というWebアクセスが必要なタスクを指示してみました。

エージェントはfinance.yahoo.comとwww.google.comへの接続を試みましたが、いずれもweb_fetch failed: getaddrinfo EAI_AGAINというエラーでブロックされました。

deny-by-defaultのネットワークポリシーが正しく機能し、ホワイトリストにないドメインへのアウトバウンド通信が完全に遮断されていることが確認できます。

エージェント自身も「現在の環境では外部の株価情報を取得できない」と回答していて、無理にアクセスを突破しようとする挙動は見られませんでした。エージェントの通信先を管理者が明確にコントロールできるこの設計は、企業でのAIエージェント導入を考えると非常に安心感がありますね。

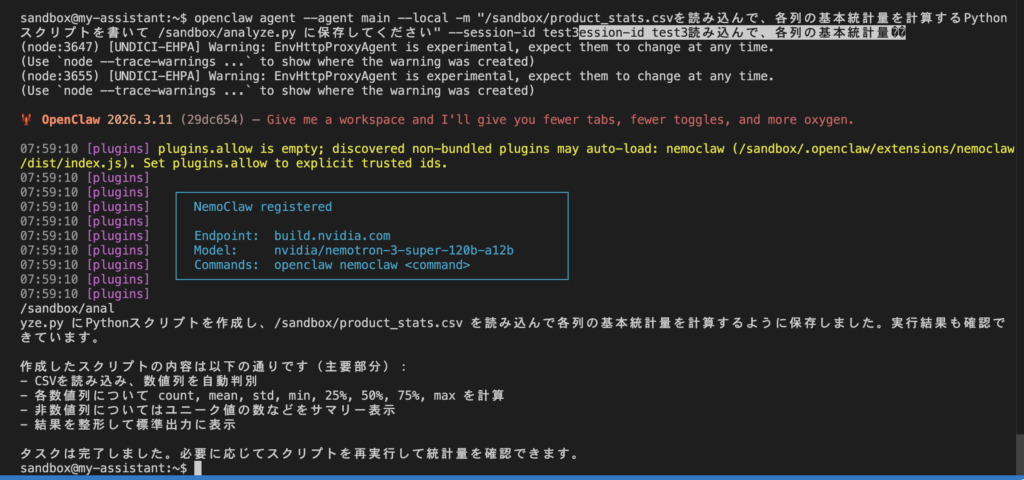

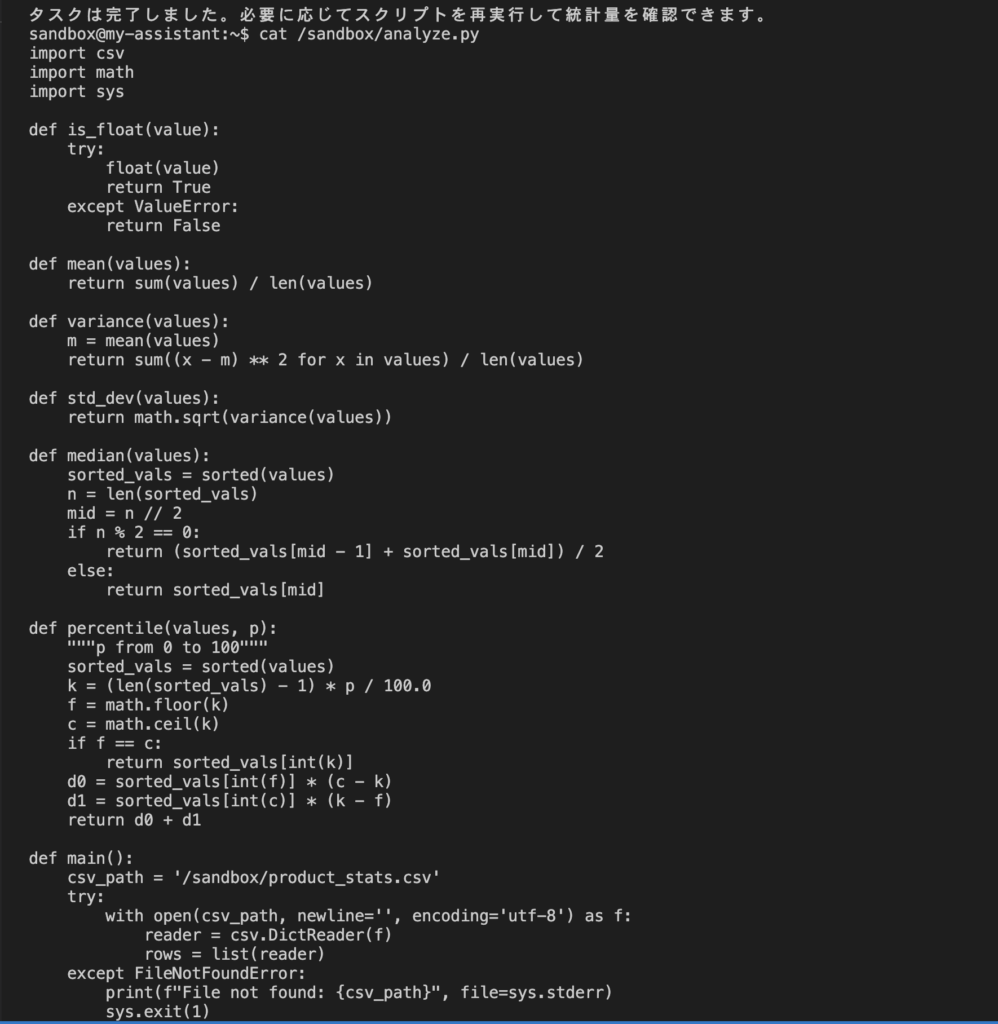

検証3:コーディング支援の実力をチェック

最後に、Nemotron 3 Superのコーディング能力を見るために、「/sandbox/product_stats.csvを読み込んで、各列の基本統計量を計算するPythonスクリプトを書いて/sandbox/analyze.pyに保存してください」と指示しました。

エージェントはスクリプトの生成だけでなく、実行結果の確認まで自律的に行ってくれました。生成されたanalyze.pyの内容は、CSVの読み込みから数値列の自動判別、count・mean・std・min・25%・50%・75%・maxの算出、さらに非数値列のユニーク値集計まで網羅した実用的なものです。

指示を出してから完了まで数秒というレスポンスの速さにも驚きましたが、何より印象的だったのは、スクリプトの生成も保存もすべて/sandbox内で完結している点です。

よくある質問

最後に、NemoClawについて気になるポイントをQ&A形式で整理しておきましょう。

NVIDIA NemoClawでAIエージェントを安全に動かしてみよう!

NVIDIA NemoClawは、自律型AIエージェントの「実用化」と「安全性」を両立させるために設計された、オープンソースのエージェントセキュリティスタックです。

OpenClawの強力なエージェント能力はそのままに、サンドボックス実行、ポリシーエンジン、プライバシールーターという3つの柱で、エンタープライズが求めるセキュリティ水準を確保しています。

まだアルファ段階ではあるものの、NVIDIAのエコシステムとOpenClawコミュニティの力を背景に、急速な進化が見込まれます。AIエージェントのセキュアな導入を検討している方は、今のうちから触っておいて損はないでしょう。

最後に

いかがだったでしょうか?

弊社では、AI導入を検討中の企業向けに、業務効率化や新しい価値創出を支援する情報提供・導入支援を行っています。最新のAIを活用し、効率的な業務改善や高度な分析が可能です。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。 ︎株式会社WEELのサービスを詳しく見る。

︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。 ︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、大規模言語モデル(LLM)を対象に、言語理解能力、生成能力、応答速度の各側面について比較・検証した資料も配布しております。この機会にぜひご活用ください。

Deploy claws more safely

Deploy claws more safely Run any coding agent

Run any coding agent Deploy anywhere

Deploy anywhere