- Z.ai発、2026年2月リリースのフラッグシップモデル「GLM-5」をベースに、エージェント駆動環境での高速推論と安定性に特化したモデル

- OpenClawのようなマルチステップのエージェントワークフローにおいて、ツール呼び出しや複雑な命令分解、長時間チェーンタスクの処理能力が大幅に強化

- 利用料金は、ベースモデルのGLM-5と比較して高くなっている

2026年3月16日、中国のAI企業であるZ.aiが、新モデル「GLM-5-Turbo」を公開しました!

GLM-5-Turboは、2026年2月にリリースされたフラッグシップモデル「GLM-5」をベースに、エージェント駆動環境での高速推論と安定性に特化したモデルです。

特に、OpenClawのようなマルチステップのエージェントワークフローにおいて、ツール呼び出しや複雑な命令分解、長時間チェーンタスクの処理能力が大幅に強化されています。

そこで本記事では、GLM-5-Turboの概要から技術的な仕組み、料金体系、具体的な使い方、そして実際に試した検証結果まで、幅広く解説していきます。

エージェントAIの活用を検討しているエンジニアの方や、コスト効率の高いLLMを探している方は、ぜひ最後までご覧ください。

\生成AIを活用して業務プロセスを自動化/

GLM-5-Turboとは?

GLM-5-Turboは、Z.aiが開発した大規模言語モデル「GLM-5」ファミリーの高速推論バリアントです。

GLM-5-Turboの土台となるGLM-5は、総パラメータ数744B(うちアクティブパラメータ40B)のMixture of Experts(MoE)アーキテクチャを採用した大規模モデルです。28.5兆トークンのデータで事前学習されていて、SWE-bench Verifiedで77.8、AIME 2026で92.7といったスコアを記録し、オープンウェイトモデルとしてトップクラスの性能を誇っています。

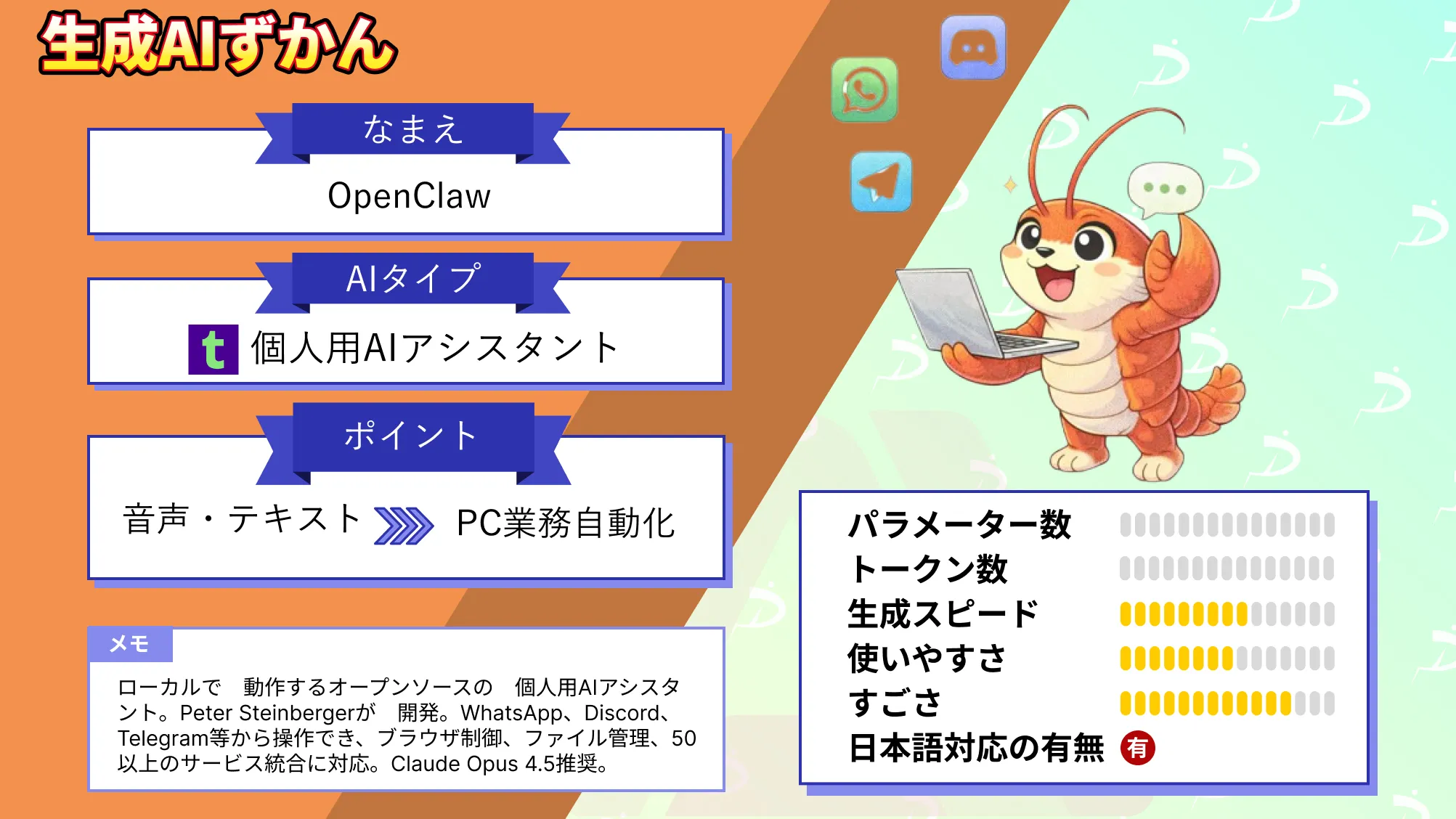

GLM-5-Turboは、このGLM-5をベースに「OpenClawシナリオへの最適化」を施したモデルです。OpenClawとは、Z.aiが提供するパーソナルAIアシスタントで、ターミナルやWeb UI、Discord、Slackなど複数のチャネルで動作し、スキルやプラグインによって拡張できるエージェント実行環境です。

GLM-5-Turboは、こうしたエージェント環境での長時間のタスク実行チェーンにおいて、安定性と効率を高めるために設計されています。

なお、GLM-5について、詳しく知りたい方は以下の記事も参考にしてみてください。

GLM-5-Turboの仕組み

GLM-5-Turboのアーキテクチャや動作原理について解説します。ベースモデルであるGLM-5の設計思想を理解すると、Turboバリアントの特性もより深く理解できるかと思います。

アーキテクチャ:Mixture of Experts(MoE)

GLM-5は、744Bの総パラメータのうち40Bのみをアクティブに使用するMoEアーキテクチャを採用しています。入力トークンごとに最適なエキスパートモジュールを選択的に起動することで、巨大なパラメータ空間の知識を活用しつつ、推論時の計算コストを抑えています。

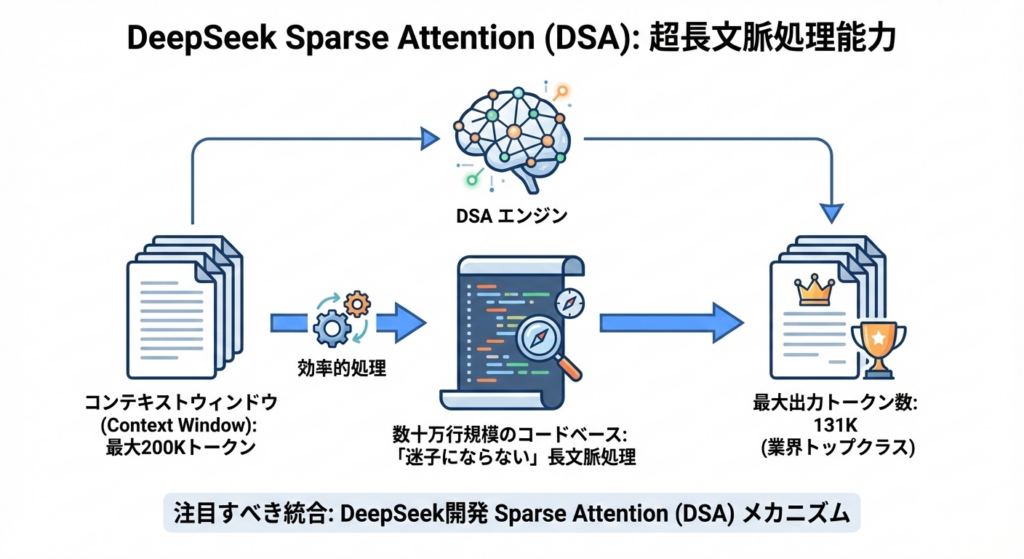

さらに、DeepSeek Sparse Attention(DSA)を初めて統合しており、長文処理時の性能を維持しながらデプロイコストを削減しています。

これによって、200Kトークンという大きなコンテキストウィンドウを実用的な速度で処理できるようになっています。

学習手法:SLIMEによる非同期強化学習

GLM-5の事後学習には、「SLIME」と呼ばれる独自の非同期強化学習(RL)基盤が使われています。

従来のRLでは、トラジェクトリ生成がボトルネックとなり、学習時間の90%以上を占めることがありました。SLIMEでは、Active Partial Rollouts(APRIL)などのシステムレベル最適化を組み込むことで、トラジェクトリを独立に並列生成し、学習スループットを大幅に向上させています。

GLM-5-Turboの最適化ポイント

GLM-5-Turboでは、上記のアーキテクチャをベースに、以下の4つの領域で追加の最適化が施されています。

- ツール呼び出しの信頼性向上

- 複雑な命令の分解・計画

- スケジュール実行と永続的タスク処理

- 長チェーン実行のスループット向上

GLM-5-Turboの特徴

GLM-5-Turboは、単に速くなったGLM-5ではありません。エージェントタスクに特化した設計上の工夫がいくつも施されています。こちらでは、他のモデルとの差別化ポイントを中心に見ていきましょう。

エージェント駆動環境への深い最適化

GLM-5-Turboの最大の特徴は、エージェント駆動環境で安定した動作を実現するための最適化です。

具体的には、長い実行チェーンにおけるツール使用の精度が向上していて、たとえば、10ステップ以上にわたるマルチステップタスクでも、途中でコンテキストを見失うことなく一貫した処理を継続できるよう設計されています。

また、複雑な命令を受け取った際に、自動的にサブタスクへ分解し、適切な実行順序を計画する能力が強化されています。

MCP統合とスキルシステム

GLM-5-TurboはMCP(Model Context Protocol)との統合をネイティブにサポートしています。

これによって、外部ツールやデータソースとの柔軟な接続が可能です。OpenClawのスキルシステムと組み合わせることで、フォルダ1つとSKILL.mdファイルだけでカスタムスキルを追加でき、ClawHubを通じてコミュニティが作成したスキルも利用することができます。

推論モード(Thinking Mode)の搭載

タスクの複雑さに応じて複数の推論モードを切り替えられる機能を備えています。推論トークンの設定をAPI側で調整できて、シンプルなタスクには軽量な推論を、複雑な問題には深い推論を適用することが可能となっています。

GLM-5ベースモデルのベンチマーク実績

GLM-5-Turbo固有のベンチマークスコアは2026年3月16日時点では公開されていませんが、ベースとなるGLM-5は以下のようなスコアを記録しており、オープンウェイトモデルとして最高水準の性能を持っています。

| ベンチマーク | GLM-5 | Claude 4.5 Opus | 備考 |

|---|---|---|---|

| SWE-bench Verified | 77.8 | 80.9 | ソフトウェアエンジニアリング |

| AIME 2026 I | 92.7 | 93.3 | 数学推論 |

| HLE(Humanity’s Last Exam) | 30.5 | 28.4 | 総合知識 |

| HLE w/ Tools | 50.4 | 43.4 | ツール活用込み |

| HMMT Nov. 2025 | 96.9 | — | 数学コンペ |

| BrowseComp | 62.0 | 37.0 | Web情報検索 |

| Terminal Bench 2.0 | 56.2 | — | ターミナル操作 |

| Vending Bench 2 | $4,432(1位) | — | ビジネスシミュレーション |

特に、BrowseCompやHLE w/ Toolsのように、ツール使用を伴うベンチマークでClaude Opus 4.5を上回っている点は評価に値しますね。

GLM-5-Turboは、このツール使用能力をさらに強化したバリアントであるため、エージェントタスクにおける実用性は非常に高いと考えられます。

GLM-5-Turboの安全性・制約

GLM-5-Turboは、入出力ともにテキストのみの対応となっており、画像や音声の処理には対応していません。マルチモーダルな処理が必要な場合は、同じZ.aiファミリーのGLM-4.6VやGLM-4.6V-FlashXといったビジョンモデルとの組み合わせを検討する必要があります。

安全性に関しては、Z.aiの公式ドキュメントやモデルカードにおいて、GLM-5-Turbo固有の詳細なセーフティガードライン情報は2026年3月16日時点では限定的となっています。

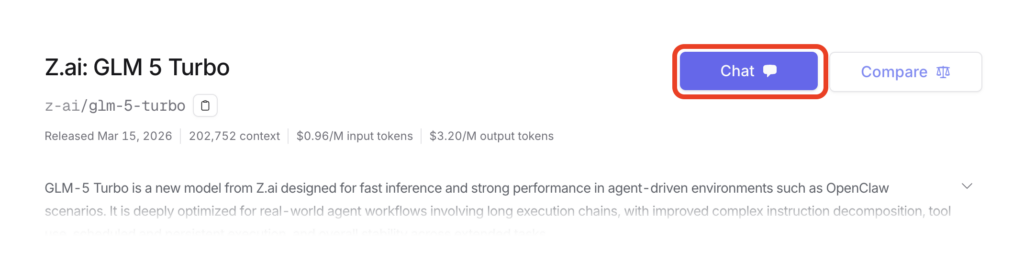

GLM-5-Turboの料金

エージェント向けモデルの選定では、トークン単価がランニングコストに直結するため、料金体系についても確認しておきましょう。以下は、Z.ai公式ドキュメントに掲載されている料金と、OpenRouterを経由した場合の料金をまとめたものです。

Z.ai公式API料金

| 項目 | 料金(1Mトークンあたり) |

|---|---|

| 入力トークン | $1.20 |

| 出力トークン | $4.00 |

| キャッシュ入力 | $0.24 |

| キャッシュストレージ | 期間限定無料 |

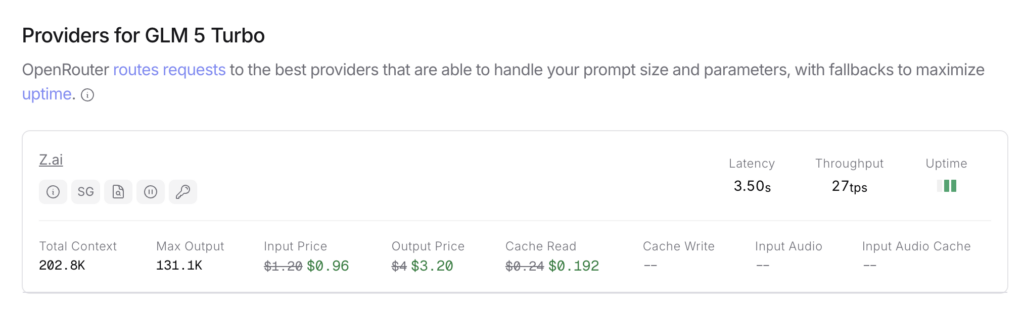

OpenRouter経由の料金

| 項目 | 料金(1Mトークンあたり) |

|---|---|

| 入力トークン | $0.96 |

| 出力トークン | $3.20 |

| キャッシュ入力 | $0.192 |

他モデルとの比較

| モデル | 入力 | 出力 |

|---|---|---|

| GLM-5 | $1.00 | $3.20 |

| GLM-5-Turbo | $1.20 | $4.00 |

| GLM-5-Code | $1.20 | $5.00 |

| GLM-4.7 | $0.60 | $2.20 |

| GLM-4.7-Flash | 無料 | 無料 |

GLM-5-Turboは、ベースモデルのGLM-5と比較すると入力で0.20、出力で0.20、出力で0.80ほど高くなっています。

一方で、OpenRouter経由では、Z.ai公式よりも約20%安い料金で利用できるため、コストを抑えたい場合はOpenRouter経由で利用するのが良いかもしれません。

なお、GLM-4.7-Flashについて、詳しく知りたい方は以下の記事も参考にしてみてください。

GLM-5-Turboのライセンス

GLM-5ファミリーはMITライセンスのもとで公開されています。

MITライセンスは、OSSのライセンスの中でも最も制約が少ないものの1つです。著作権表示とライセンス表示を保持する限り、商用プロダクトへの組み込み、改変した派生モデルの作成、再配布など、ほぼ自由に利用することができます。

| 利用形態 | 可否 |

|---|---|

| 商用利用 |  |

| 改変 |  |

| 再配布 |  |

| 特許利用 |  (MITライセンスには明示的な特許許諾条項はないが、暗黙的に許可) (MITライセンスには明示的な特許許諾条項はないが、暗黙的に許可) |

| 私的利用 |  |

Hugging Faceでは18種類の量子化バージョンや29のファインチューニング版なども公開されており、コミュニティによる二次利用も活発に行われています。

GLM-5-Turboの使い方

ここからは、GLM-5-Turboを実際に使う方法を解説します。API経由での利用と、OpenClawでの利用の大きく2パターンを紹介します。

Z.ai API経由で利用する

Z.aiの公式APIを使ってGLM-5-Turboを呼び出す方法です。OpenAI互換のChat Completions形式に対応しているため、既存のコードからの移行も容易です。

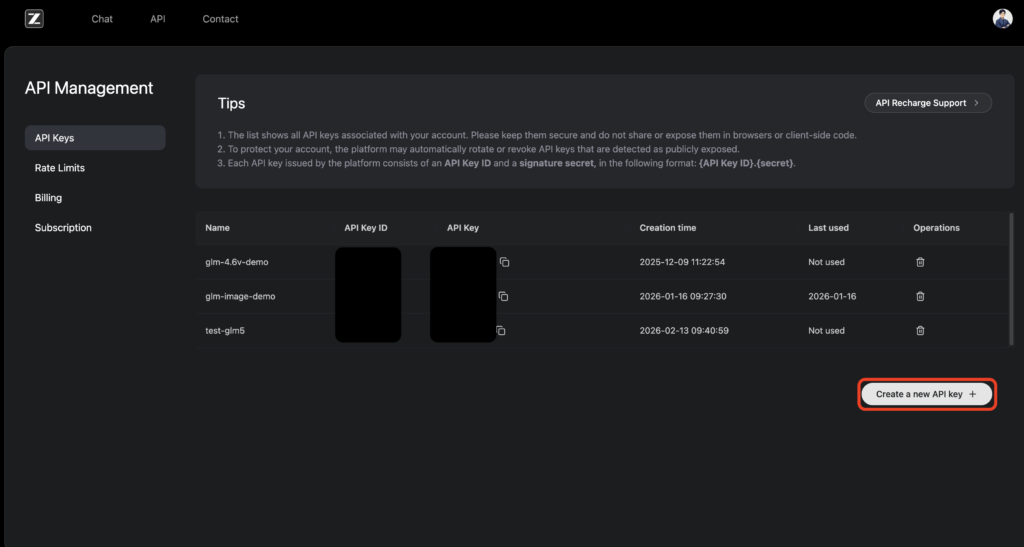

APIキーを取得する

Z.aiの開発者プラットフォーム(https://z.ai)にアクセスし、アカウントを作成します。ダッシュボードの「API Key」セクションからAPIキーを発行してください。

Python SDKをインストールする

Z.aiの公式Python SDK「zai-sdk」をインストールします。

pip install zai-sdk基本的なリクエストを送る

以下のコードで、GLM-5-Turboに簡単なリクエストを送信できます。

from zai import ZaiAI

client = ZaiAI(api_key="YOUR_API_KEY")

response = client.chat.completions.create(

model="glm-5-turbo",

messages=[

{"role": "user", "content": "Pythonで素数判定する関数を書いてください"}

],

temperature=0.7,

max_tokens=4096,

)

print(response.choices[0].message.content)Thinking Mode(推論モード)を有効にする

より深い推論を行わせたい場合は、thinkingパラメータを設定します。

response = client.chat.completions.create(

model="glm-5-turbo",

messages=[

{"role": "user", "content": "以下のコードのバグを特定し、修正案を提示してください。\n..."}

],

temperature=0.6,

extra_body={"thinking": True},

)Function Calling(ツール呼び出し)を使う

GLM-5-Turboの強みであるツール呼び出し機能の例です。

tools = [

{

"type": "function",

"function": {

"name": "get_weather",

"description": "指定された都市の天気を取得する",

"parameters": {

"type": "object",

"properties": {

"city": {"type": "string", "description": "都市名"}

},

"required": ["city"]

}

}

}

]

response = client.chat.completions.create(

model="glm-5-turbo",

messages=[

{"role": "user", "content": "東京の天気を教えてください"}

],

tools=tools,

tool_choice="auto",

)OpenAI SDK互換で利用する

既存のOpenAI SDKのコードベースから、ベースURLを変更するだけでGLM-5-Turboを利用できます。

from openai import OpenAI

client = OpenAI(

api_key="YOUR_ZAI_API_KEY",

base_url="https://api.z.ai/api/paas/v4/"

)

response = client.chat.completions.create(

model="glm-5-turbo",

messages=[

{"role": "user", "content": "Hello, GLM-5-Turbo!"}

],

)

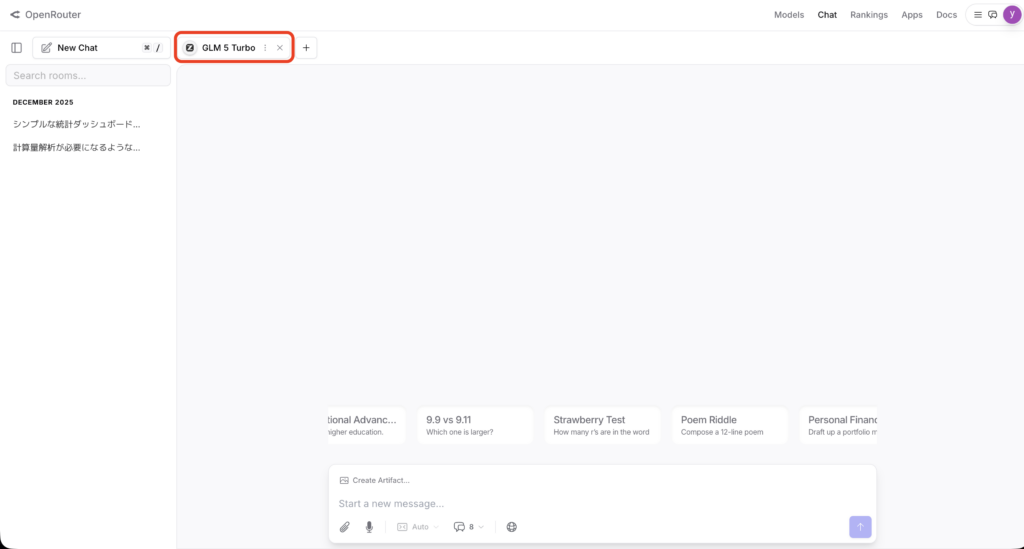

print(response.choices[0].message.content)OpenRouter経由で利用する

OpenRouterを使えば、Z.aiのアカウントを作成せずにGLM-5-Turboを利用できます。料金もZ.ai公式より約20%安くなるメリットがあります。

以下はコード例です。

from openai import OpenAI

client = OpenAI(

api_key="YOUR_OPENROUTER_API_KEY",

base_url="https://openrouter.ai/api/v1"

)

response = client.chat.completions.create(

model="z-ai/glm-5-turbo",

messages=[

{"role": "user", "content": "GLM-5-Turboの特徴を3つ教えてください"}

],

)

print(response.choices[0].message.content)なお、OpenRouter内のChat機能で試すこともできます。

OpenClawに組み込んで使う

パーソナルAIアシスタント「OpenClaw」でGLM-5-Turboを使う方法です。

OpenClawをインストールする

OpenClawの公式ドキュメントに従ってインストールを行います。

なお、OpenClawの詳しい使い方については、以下の記事をご参照ください。

設定ファイルを編集する

~/.openclaw/openclaw.jsonを開き、GLM-5-Turboをプライマリモデルとして設定します。

{

"primary": "zai/glm-5-turbo",

"models": [

{

"id": "zai/glm-5-turbo",

"context_window": 204800,

"max_tokens": 131072

}

]

}OpenClawを起動する

設定が完了したら、ターミナルからOpenClawを起動します。Discord、Slack、Web UIなど、好みのチャネルで利用を開始できます。

【業界別】GLM-5-Turboの活用シーン

GLM-5-Turboは、エージェント駆動のタスク処理に強みを持つモデルです。こちらでは、各業界でどのような使い方が効果的かを具体的に見ていきましょう。

ソフトウェア開発

GLM-5-Turboが最も活躍してくれる領域です。

ベースモデルのGLM-5がSWE-bench Verifiedで77.8、Terminal Bench 2.0で56.2というスコアを記録していることからもわかるように、コード生成・レビュー・デバッグにおいて高い性能を発揮してくれると思います。

OpenClawと組み合わせることで、IDE上での自律的なコーディングエージェントとして活用でき、マルチステップのリファクタリングやテスト生成を効率化できます。

金融・フィンテック

200Kの長いコンテキストウィンドウを活かして、大量の財務レポートや規制文書の分析に活用できると思います。

Function Calling機能を使えば、リアルタイムの市場データ取得やポートフォリオ分析のワークフローを自動化することも可能です。ツール呼び出しの安定性が高いため、複数のAPIを連携させるマルチステップの分析タスクにも向いています。

なお、金融業界における生成AI活用について、詳しく知りたい方は以下の記事も参考にしてみてください。

教育・研究

AIME 2026で92.7、HMMT Nov. 2025で96.9といったような数学推論の高スコアは、学術研究や教育分野での活用可能性を示しています。

複雑な数学的問題の解説や、研究論文の要約・分析など、深い推論を要するタスクでThinking Modeを活用することで、高品質な出力が期待できると思います。

なお、教育業界における生成AI活用について、詳しく知りたい方は以下の記事も参考にしてみてください。

【課題別】GLM-5-Turboが解決できること

実際の業務で直面する課題に対して、GLM-5-Turboがどのように役立つかについても整理していきましょう。モデルの特性に合った課題を見極めることが、効果的な活用のポイントになってきます。

マルチステップのエージェントタスクが途中で破綻する問題を解決

従来のLLMでは、10ステップ以上にわたるタスクの途中でコンテキストを見失い、出力の一貫性が崩れるケースが見受けられました。

GLM-5-Turboは、長チェーン実行の安定性に特化した最適化が施されており、マルチエージェント間の連携やタスクの時間的一貫性を維持する設計になっています。エージェントフレームワークでの長時間タスクが安定しないという課題に対して、有効な選択肢になると思います。

外部ツール連携の精度を上げる

Function Callingの精度が低いと、間違った引数でAPIを呼び出してしまったり、必要なツール呼び出しがスキップされたりする問題が発生すると思います。

GLM-5-Turboは、ツール呼び出しの信頼性向上に注力しており、BrowseCompで62.0(Claude 4.5の37.0を大幅に上回る)、MCP-Atlasでもオープンモデル1位のスコアを記録しています。外部ツールとの連携が多いワークフローにおいて、この精度差は運用上で大きな違いを生み出してくれると思います。

コスト効率の高いオープンモデルとして利用できる

クローズドモデルと比較して、GLM-5-Turboは入力1.20/1Mトークン、出力1.20/1Mトークン、出力4.00/1Mトークンといったような料金で、SWE-bench Verified 77.8相当の性能を利用することができます。

さらに、OpenRouter経由であれば約20%のコスト削減も可能です。MITライセンスのオープンウェイトモデルであるため、将来的にオンプレミスでのデプロイに切り替えてAPIコストをゼロにするという選択肢も見えてくると思います。

GLM-5-Turboを使ってみた

ここからは、実際にGLM-5-Turboを動かしてその実力を検証していきます。

今回はAPIではなく、OpenRouterのチャット機能を使って手軽に試しました。コードを書かずにブラウザだけで検証できるので、気になった方はぜひ同じ手順で試してみてください。

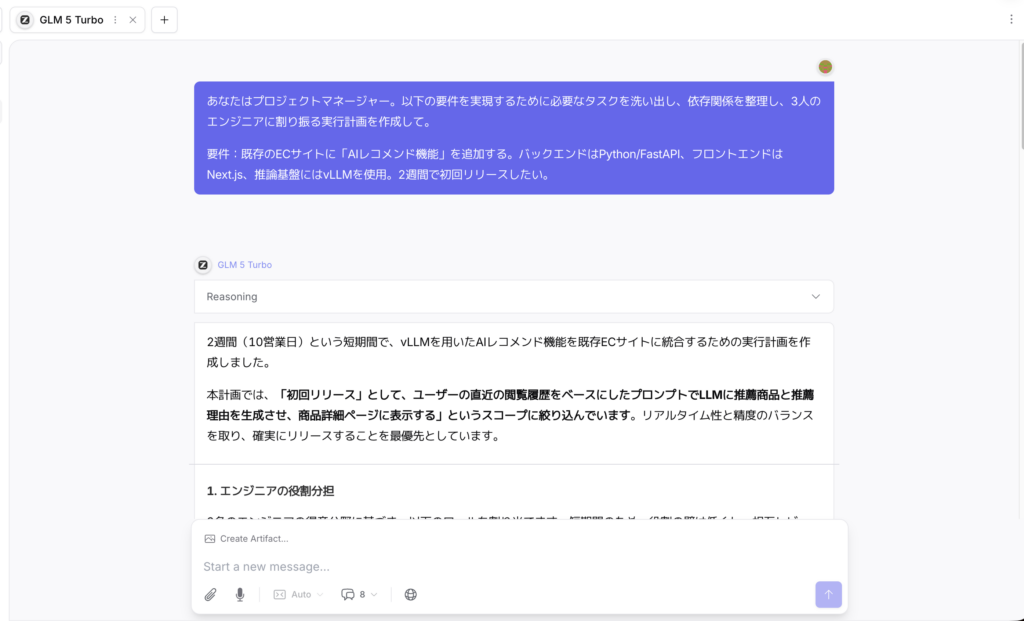

検証①:複雑な命令の分解・計画能力を試す

GLM-5-Turboの強みである「複雑な命令を分解して計画を立てる能力」を確認するため、以下のプロンプトを投げてみました。

あなたはプロジェクトマネージャー。以下の要件を実現するために必要なタスクを洗い出し、依存関係を整理し、3人のエンジニアに割り振る実行計画を作成して。

要件:既存のECサイトに「AIレコメンド機能」を追加する。バックエンドはPython/FastAPI、フロントエンドはNext.js、推論基盤にはvLLMを使用。2週間で初回リリースしたい。出力結果はこちら

2週間(10営業日)という短期間で、vLLMを用いたAIレコメンド機能を既存ECサイトに統合するための実行計画を作成しました。

本計画では、**「初回リリース」として、ユーザーの直近の閲覧履歴をベースにしたプロンプトでLLMに推薦商品と推薦理由を生成させ、商品詳細ページに表示する」というスコープに絞り込んでいます**。リアルタイム性と精度のバランスを取り、確実にリリースすることを最優先としています。

---

### 1. エンジニアの役割分担

3名のエンジニアの得意分野に基づき、以下のロールを割り当てます。短期間のため、役割の壁は低くし、相互レビューを必須とします。

* **エンジニアA(ML/インフラ担当)**: vLLM環境構築、モデル選定・デプロイ、プロンプトエンジニアリング、推論パフォーマンス調整

* **エンジニアB(バックエンド担当)**: FastAPIでのAPI開発、既存DBからのユーザー履歴/商品情報取得ロジック、vLLMサーバーとの通信、レスポンス整形

* **エンジニアC(フロントエンド担当)**: Next.jsでのUIコンポーネント開発、API連携、既存ページへのレコメンドUI組み込み、ローディング/エラーハンドリング

---

### 2. タスク洗い出しと依存関係

タスクは大きく「準備」「実装」「結合・リリース」の3フェーズに分けます。

<details>

<summary><b>📋 タスク一覧と依存関係の詳細(クリックして展開)</b></summary>

#### 【フェーズ1:準備・設計】(Day 1)

* `T01` [全員] 要件確認・スキーマ定義(リクエスト/レスポンスJSONの決定)

* `T02` [A] 推論環境(GPUサーバー等)の確保とvLLMインストール

* `T03` [A] レコメンド用LLMの選定(日本語対応、軽量・高速なモデル推奨)

* `T04` [B] 既存DB構造の確認と、履歴取得クエリの設計

* `T05` [C] レコメンドUIのモックアップ作成(Figma等)※もし無ければ簡易的なHTMLでOK

#### 【フェーズ2:並列実装】(Day 2〜5)

* **vLLM/ML**

* `T06` [A] vLLMでのモデルサービング起動(`T03`に依存)

* `T07` [A] プロンプトの設計とテスト(商品データ構造のフォーマット化含む)(`T06`に依存)

* `T08` [A] 推論レイテンシの計測とチューニング(`T07`に依存)

* **バックエンド**

* `T09` [B] DBからユーザー履歴・商品データを取得するロジック実装(`T04`に依存)

* `T10` [B] FastAPIのエンドポイント作成(モックレスポンス返却)(`T01`に依存)

* `T11` [B] vLLMへのHTTPリクエスト処理と最終レスポンス生成(`T09`, `T07`完了時に開始可能)

* **フロントエンド**

* `T12` [C] レコメンド表示コンポーネントの実装(`T05`に依存)

* `T13` [C] バックエンドAPI(モック)からのデータ取得と表示ロジック(`T10`, `T12`に依存)

* `T14` [C] スケルトンローディング・エラー時のフォールバック実装(`T13`に依存)

#### 【フェーズ3:結合・リリース】(Day 6〜10)

* `T15` [B,C] バックエンドとフロントエンドのAPI結合(`T11`, `T13`に依存)

* `T16` [A,B] vLLMとFastAPIの結合、全体E2Eテスト(`T08`, `T11`に依存)

* `T17` [C] 既存の商品詳細ページへのコンポーネント組み込み(`T15`に依存)

* `T18` [全員] パフォーマンス改善(キャッシュ導入、タイムアウト設定等)(`T16`, `T17`に依存)

* `T19` [全員] ステージング環境での最終レビューとバグ修正(`T18`に依存)

* `T20` [全員] 本番デプロイと監視設定(`T19`に依存)

</details>

---

### 3. 2週間の実行スケジュール(10営業日)

短期間のため、前半は「スキーマ定義」を最優先し、後半は「パフォーマンスチューニングとフォールバック」に時間を割いています。

| 営業日 | エンジニアA (ML/Infra) | エンジニアB (Backend) | エンジニアC (Frontend) | デイリーデモ/MTG |

| :--- | :--- | :--- | :--- | :--- |

| **Day 1** | `T02` 環境構築<br>`T03` モデル選定 | `T01` スキーマ定義(主導)<br>`T04` DB設計 | `T01` スキーマ定義<br>`T05` UIモック作成 | スキーマ確定会議 |

| **Day 2** | `T06` vLLM起動 | `T09` DB取得ロジック実装 | `T12` UIコンポーネント実装 | 進捗共有 |

| **Day 3** | `T07` プロンプト設計・検証 | `T10` APIエンドポイント作成(モック) | `T13` モックAPI連携 | 進捗共有 |

| **Day 4** | `T08` 推論レイテンシ計測 | `T11` vLLM通信実装 | `T14` ローディング・エラー処理 | **中間デモ** (モック動作確認) |

| **Day 5** | `T08` チューニング継続 | `T11` レスポンス整形・完成 | `T14` UI微調整 | 進捗共有 |

| **Day 6** | `T16` 全体結合テスト(A-B間) | `T15` API結合(B-C間) | `T15` API結合(B-C間) | **結合デモ** |

| **Day 7** | `T18` 応答速度のボトルネック解消 | `T18` バックエンド最適化(非同期化等) | `T17` 既存ページへの組み込み | 進捗共有 |

| **Day 8** | `T18` プロンプト推論のタイムアウト制御 | `T18` DBクエリ最適化 | `T17` レスポンシブ対応・調整 | 進捗共有 |

| **Day 9** | `T19` E2Eテスト・バグ出し | `T19` E2Eテスト・バグ出し | `T19` E2Eテスト・バグ出し | **リハーサル** |

| **Day 10** | `T20` 本番デプロイ(監視設定) | `T20` 本番デプロイ(DB・API) | `T20` 本番デプロイ(FE) | **リリース後振り返り** |

---

### 4. スコープ外(初回リリースでは手を付けないもの)

2週間で確実にリリースするため、以下は意図的にスコープから外します。これらはリリース後の改善タスク(v2)とします。

* **バッチ処理による全ユーザー事前計算**(今回はアクセス時のリアルタイム推論のみ)

* **A/Bテストツールとの連携**(UI上でON/OFFできる簡易機能にとどめる)

* **RAG(検索拡張生成)の導入**(ベクトルDB構築が間に合わないため、プロンプトに直接商品データを渡す手法とする)

* **クリック率等の効果測定パイプライン**(ログは残すが、ダッシュボード化は次回)

---

### 5. 短期開発を成功させるための重要ルール

1. **徹底したモックファースト**

Day 1でJSONのスキーマを絶対に固めます。これにより、AがvLLMの準備ができていなくても、BとCはモックデータで並列開発を進められます。

2. **「推薦理由」のフォーマット固定**

LLMの出力をそのままHTMLにレンダリングするとXSSのリスクやレイアウト崩れの原因になります。LLMには「推薦理由を50文字以内で出力せよ」と制約をかけ、単なる文字列として扱います。

3. **厳格なタイムアウトとフォールバック**

vLLMは重い場合があります。FastAPI側で **2秒以内に応答が返らない場合は、既存の「ランキング人気商品」を返す** というフォールバックロジックを必ず実装します。ユーザー体験を最優先します。

4. **1日15分のデイリー同步**

毎日終業前に15分だけ進捗を合わせ、ブロッカー(Aの環境構築待ち等)がないか即座に解消します。単にタスクを羅列するのではなく、依存関係のクリティカルパスを意識した計画になっていて良い感じです。リアルタイム性と精度のバランスを取り、確実にリリースすることを最優先にしている判断も的確で、実務でも使えそうなレベルだと思います。

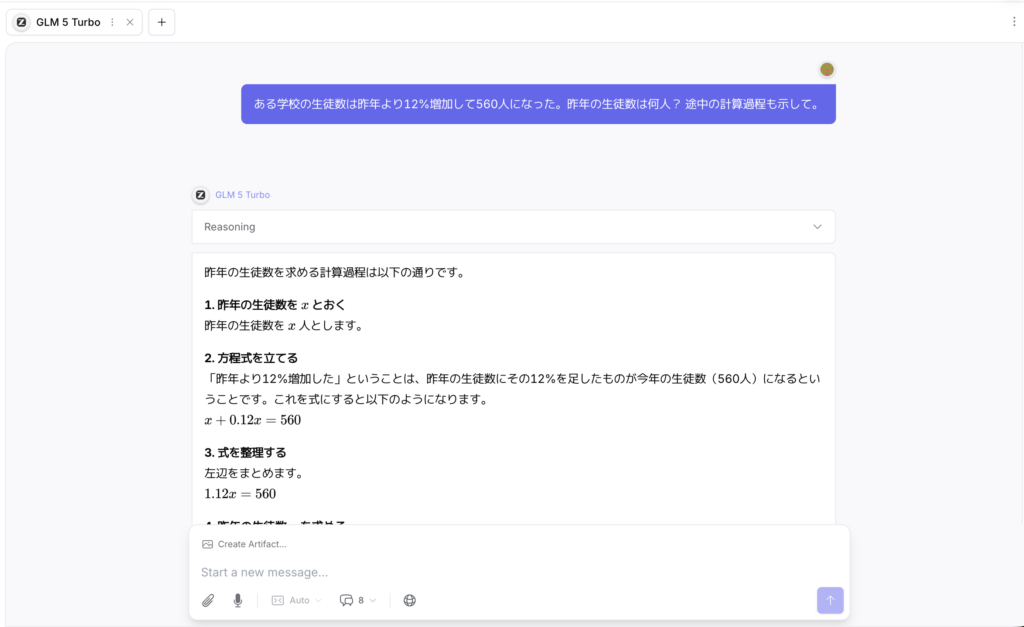

検証②:日本語の推論能力を試す

Z.aiは中国企業であるため、日本語性能も気になるところですよね。そこで、数学推論と論理推論をそれぞれ日本語で試してみましょう。

ある学校の生徒数は昨年より12%増加して560人になった。昨年の生徒数は何人? 途中の計算過程も示して。出力結果はこちら

昨年の生徒数を求める計算過程は以下の通りです。

**1. 昨年の生徒数を $x$ とおく**

昨年の生徒数を $x$ 人とします。

**2. 方程式を立てる**

「昨年より12%増加した」ということは、昨年の生徒数にその12%を足したものが今年の生徒数(560人)になるということです。これを式にすると以下のようになります。

$$x + 0.12x = 560$$

**3. 式を整理する**

左辺をまとめます。

$$1.12x = 560$$

**4. 昨年の生徒数 $x$ を求める**

両辺を $1.12$ で割ります。

$$x = \frac{560}{1.12}$$

計算しやすいように、分子と分母に100をかけます。

$$x = \frac{56000}{112}$$

割り算をします。

$$x = 500$$

**答え:**

昨年の生徒数は **500人** です。

<strong>(確認:500人の12%は $500 \times 0.12 = 60$ です。500人に60人を足すと $500 + 60 = 560$ 人となり、条件と一致します。)</strong>正解は500人ですが、GLM-5-Turboは計算過程を丁寧に提示しながら正答を出してくれました。

AIME 2026で92.7というベースモデルのスコアを考えれば当然かもしれませんが、日本語での説明も自然で充分なレベル感だと思います。

そして何より出力までかなりスピーディだと感じました。今回は試していませんが、エージェント駆動環境での高速性にも期待できそうな印象です。

よくある質問

最後に、GLM-5-Turboに関して、よくある質問とその回答をご紹介します。

まとめ

GLM-5-Turboの最大の魅力は、エージェント駆動環境に特化した最適化が施されている点です。

長いチェーンタスクにおける安定性、ツール呼び出しの信頼性、複雑な命令の分解・計画能力など、マルチステップのエージェントタスクをこなす上で重要な能力が強化されています。

ベースモデルのGLM-5はSWE-bench Verified 77.8やBrowseComp 62.0など、オープンウェイトモデルとしてトップクラスのベンチマークスコアを記録していて、MITライセンスで利用できるのも大きな強みだと思います。

エージェントAIの実用化に取り組んでいるエンジニアの方は、ぜひ一度試してみてください。

最後に

いかがだったでしょうか?

弊社では、AI導入を検討中の企業向けに、業務効率化や新しい価値創出を支援する情報提供・導入支援を行っています。最新のAIを活用し、効率的な業務改善や高度な分析が可能です。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。 ︎株式会社WEELのサービスを詳しく見る。

︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。 ︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、大規模言語モデル(LLM)を対象に、言語理解能力、生成能力、応答速度の各側面について比較・検証した資料も配布しております。この機会にぜひご活用ください。